In der dynamischen Welt der Webbrowser spielt die Effizienz von maschinellen Lernmodellen eine entscheidende Rolle für Geschwindigkeit, Genauigkeit und eine nahtlose Nutzererfahrung. Google Chrome geht mit der aktuellen Version einen bedeutenden Schritt voran, indem es ein neues Text-Embedding-Modell einführt. Dieses Modell ist bemerkenswert kleiner als sein Vorgänger, arbeitet schneller und erhält dennoch die gleiche hervorragende Qualität in semantischen Suchanwendungen. Die technischen Innovationen hinter dieser Verbesserung tragen nicht nur zu einem optimierten Ressourcenmanagement bei, sondern haben auch einen direkten Mehrwert für die Nutzer, vor allem auf mobilen und ressourcenbegrenzten Geräten. Der Kern dieses Fortschritts liegt in der Reduzierung der Modellgröße.

Das neue Embedding-Modell benötigt nur noch etwa 35 Megabyte Speicherplatz, was einer Verringerung von 57 Prozent gegenüber dem vorherigen Modell mit etwa 82 Megabyte entspricht. Diese drastische Verkleinerung wurde durch eine gezielte Quantisierung erreicht. Dabei wurde die Darstellung der größten Gewichtsmatrix, die ursprünglich im 32-Bit Fließkommaformat gespeichert war, auf ein 8-Bit-Ganzzahlschema umgestellt. Dieser Quantisierungsschritt ist bemerkenswert, da er die Modellgröße deutlich verringert, ohne Einbußen bei der Präzision oder der Qualität der Suchergebnisse zu verursachen. Die technische Umsetzung erforderte eine sorgfältige Abstimmung und umfassende Tests.

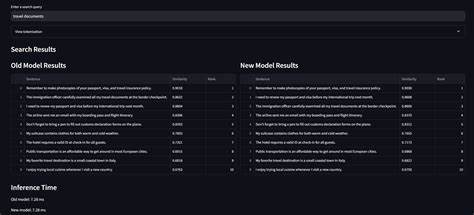

Trotz der internen Umstellung auf weniger präzise Zahlenformate behalten die Ausgaben des Modells die ursprüngliche Präzision von 32 Bit bei, was auf fortgeschrittene quantisierungsbewusste Trainingsmethoden schließen lässt. Tatsächlich ist die effektive Genauigkeit der Embeddings des neuen Modells sogar leicht verbessert, was auf eine intelligente Kompensation durch das Training hindeutet. Für Anwender bedeutet das vor allem, dass die Qualität der semantischen Suche vollständig erhalten bleibt. Tests mit vielfältigen Suchanfragen aus verschiedenen Themenbereichen wie Umweltschutz, Künstliche Intelligenz oder Reisedokumente zeigten keine relevanten Unterschiede im Ranking der Suchergebnisse. Die errechneten Ähnlichkeitsscores unterschieden sich nur marginal.

Parallel dazu konnte eine minimale Steigerung der Verarbeitungsgeschwindigkeit im Bereich von ein bis zwei Prozent festgestellt werden, was zu einem flüssigeren und reaktiveren Sucherlebnis führt. Ein weiterer entscheidender Vorteil dieser Modelloptimierung liegt in der Effizienz der Ressourcenverwendung. Vor allem bei Geräten mit begrenztem Speicher, wie billigeren Smartphones oder Tablets, bedeutet das kleinere Modell eine spürbare Reduzierung des erforderlichen Speicherplatzes. Dadurch entsteht mehr freier Speicher für andere Anwendungen und Daten. Auch die Update-Prozesse von Chrome profitieren von einem kompakteren Modell, da die herunterzuladenden Daten erheblich reduziert werden.

Dies spart nicht nur Zeit, sondern auch kostbaren Datenvolumen, was besonders für Nutzer mit mobilen Datenverträgen relevant ist. Die Optimierung geht jedoch über den Speicher- und Bandbreitenvorteil hinaus. Weniger komplexe, kleinere Modelle bedeuten generell auch einen geringeren Energieverbrauch während der Inferenz, also bei der Berechnung der Modellvorhersagen. Dies wirkt sich positiv auf die Akkulaufzeit von mobilen Geräten aus, was für viele Nutzer eine wichtige Rolle spielt, insbesondere bei längeren Browsersitzungen ohne direkte Stromversorgung. Der Entwicklungsprozess hinter dieser Innovation zeigt, wie die Kombination aus moderner Quantisierungstechnik und feinem Training zur Erhaltung der Modellqualität neue Maßstäbe setzt.

Anstatt das gesamte Modell pauschal zu quantisieren und damit potenziell Präzision einzubüßen, konzentrierten sich die Entwickler auf die größte Gewichtsmatrix des Modells, die den größten Speichervorteil verspricht. Solch ein gezielter Ansatz spielt vor allem für Edge-Anwendungen eine wesentliche Rolle, bei denen Hardware-Ressourcen begrenzt sind, aber trotzdem höchste Leistung gefordert wird. Neben der Umsetzung erlaubt der offene Einblick in die Modellstruktur und deren Analyse durch fortgeschrittene Werkzeuge eine bessere Nachvollziehbarkeit und die Möglichkeit, zukünftige Verbesserungen noch gezielter zu gestalten. Dies sorgt für Transparenz und fördert das Vertrauen in die Implementierung komplexer maschineller Lernprozesse direkt im Browser. Zusätzlich zu den technischen Vorteilen zeigt sich klar, wie sich solche Innovationen langfristig auf die globale Nutzung von Webbrowsern auswirken können.

Kleinere Modelle erleichtern es, leistungsfähige Funktionen auch auf niedrigpreisigen, global verbreiteten Geräten anzubieten. Dies trägt zu einer größeren digitalen Inklusion bei und sorgt dafür, dass fortschrittliche Technologien nicht nur einer begrenzten Nutzergruppe vorbehalten bleiben. Der Ansatz von Google Chrome ist damit ein wegweisendes Beispiel dafür, wie High-End-Technologien und Benutzerfreundlichkeit harmonisch miteinander verbunden werden können. Die Optimierung des Text-Embedding-Modells repräsentiert zugleich die beständige Weiterentwicklung des Browsers als intelligente Plattform, die maschinelles Lernen nutzt, um das Surferlebnis zu verbessern, ohne Kompromisse bei Geschwindigkeit und Speicherverbrauch einzugehen. Zusammenfassend lässt sich festhalten, dass Chromes neues Embedding-Modell eine technische Meisterleistung darstellt, die zahlreiche Vorteile für Nutzer und Entwickler bietet.

Die dramatische Verkleinerung bei gleichzeitig verbesserter oder zumindest gleichbleibender Modellqualität zeigt die Möglichkeiten moderner Quantisierungstechniken auf. Die daraus resultierenden schnelleren Ladezeiten, geringerer Speicherbedarf und bessere Energieeffizienz schaffen eine ideale Balance zwischen technologischer Innovation und praktischen Anwenderbedürfnissen. Mit Blick auf die Zukunft sind weitere Fortschritte in diesem Bereich zu erwarten. Die Integration von noch intelligenteren Komprimierungs- und Trainingsverfahren könnte dazu führen, dass Modelle künftig noch kompakter, leistungsfähiger und flexibler werden. Solche Entwicklungen fördern nicht nur die Performance auf Geräten aller Art, sondern ebnen auch den Weg für neue, innovative Anwendungen im Browser-Umfeld, von personalisierter Suche bis hin zu fortschrittlichen Inhaltsanalysen.

Google Chrome demonstriert damit eindrucksvoll, wie maschinelles Lernen auf effiziente Weise direkt im Browser eingesetzt werden kann. Das neue Embedding-Modell setzt neue Standards in Sachen Effizienz, Geschwindigkeit und Nutzerorientierung und unterstreicht den Stellenwert von Edge-Intelligenz in der modernen Internetnutzung.