Die menschliche Denkweise entwickelt sich kontinuierlich weiter, und in der heutigen Zeit ist der Einsatz digitaler Technologien ein zentraler Treiber dieser Entwicklung. Die Theorie des erweiterten Geistes, geprägt von den Philosophen Andy Clark und David Chalmers, hebt einen Aspekt hervor, der besonders im Zeitalter der Künstlichen Intelligenz an Bedeutung gewinnt: Unsere kognitiven Fähigkeiten sind nicht nur auf das Gehirn beschränkt, sondern erweitern sich durch die Einbindung von externen Werkzeugen und Technologien. Diese Erweiterung des Geistes ermöglicht eine ganz neue Art des Denkens, bei der digitale Instrumente zu einem integralen Bestandteil unserer geistigen Prozesse werden. Gerade Large Language Models (LLMs) wie ChatGPT verkörpern dabei eine transformative Neuerung, denn sie sind nicht nur passive Informationsquellen, sondern aktive Dialogpartner, die mit uns zusammenarbeiten. Dieses neue Zusammenspiel bringt jedoch nicht nur Chancen, sondern auch erhebliche Herausforderungen mit sich.

Vor der Ära der ausgefeilten Sprachmodelle waren digitale Werkzeuge wie Suchmaschinen oder Online-Enzyklopädien primär Informationslieferanten. Nutzer mussten die erhaltenen Daten eigenständig bewerten und zusammenführen, um zu eigenständigen Erkenntnissen zu gelangen. Diese Werkzeuge fungierten als Erweiterungen unseres Gedächtnisses oder als Zugang zu gespeichertem Wissen, beeinflussten aber nicht direkt den Denkprozess an sich. Die entscheidende Synthese lag komplett in der Verantwortung des Menschen, der durch reflektiertes Abwägen verschiedener Quellen zu fundierten Schlussfolgerungen gelangte. Mit dem Aufkommen von LLMs verändert sich diese Beziehung grundlegend, denn die Modelle generieren auf Basis umfangreicher Trainingsdaten nicht nur Fakten, sondern auch sprachliche Formulierungen und strukturierte Gedanken.

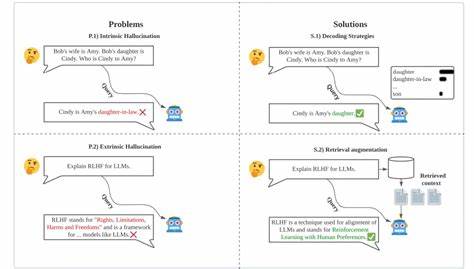

Das bedeutet, dass die Denkprozesse nicht mehr nur darin bestehen, vorhandene Informationen zu suchen, sondern in einem interaktiven Dialog mit der KI zu agieren. Die Rolle des Menschen verlagert sich vom passiven Konsumenten hin zum aktiven Steuermann eines kreativen Prozesses, bei dem Fragen präzise formuliert und Ausgaben sorgfältig evaluiert werden müssen. Diese iterativen Feedbackschleifen eröffnen neue Möglichkeiten, komplexe Inhalte zu strukturieren, unterschiedliche Perspektiven zu analysieren oder kreative Lösungsansätze zu entwickeln – jedoch unter der permanenten Notwendigkeit einer kritischen Bewertung seitens des Nutzers. Die Herausforderung besteht darin, dass LLMs auf umfangreichen Textsammlungen aus dem Internet und anderen Quellen trainiert sind, die unausweichlich menschliche Vorurteile, kulturelle Prägungen und soziale Bias enthalten. Obwohl die Modelle beeindruckend sprachlich überzeugende Texte erstellen, können in diesen Generationen subtile oder auch offensichtliche Verzerrungen stecken.

Das Risiko besteht darin, dass Nutzer, wenn sie diese Inhalte unkritisch übernehmen, nicht nur falsche oder einseitige Informationen akzeptieren, sondern gleichzeitig unbewusst die darin enthaltenen Denkmuster und Annahmen internalisieren und reproduzieren. Dadurch wird der erweiterte Geist nicht nur zu einem Werkzeug zur Wissensbeschaffung, sondern möglicherweise auch zu einem Verstärker für bestehende Stereotype und Denkfehler. Eine weitere Dimension der Herausforderung liegt in der rhetorischen Gestaltung der von LLMs erzeugten Texte. Die Modelle produzieren häufig gut strukturierte, flüssige und inhaltlich zugängliche Formulierungen, die eine hohe Überzeugungskraft besitzen können. Diese Qualität birgt die Gefahr, dass formaler Stil und Ästhetik der Sprache fälschlicherweise als Kennzeichen für fachliche Tiefe oder inhaltliche Richtigkeit gewertet werden.

Wenn sich Nutzer an diese Art der sprachlichen Aufbereitung gewöhnen, kann die Fähigkeit zur eigenständigen, differenzierten Argumentation und zum kritischen Denken beeinträchtigt werden. Die Abhängigkeit von der KI als kognitivem Partner erfordert deshalb eine bewusste Haltung, um überzeugende Formulierungen und belastbare Argumente auseinanderhalten zu können. Auch die aktive Rolle des Nutzers bei der Gestaltung des Austauschs mit der KI darf nicht unterschätzt werden. Die Art und Weise, wie Fragen gestellt und Anweisungen formuliert werden, beeinflusst maßgeblich die Antworten und damit den Denkprozess. Da wir Menschen alle von eigenen Erfahrungen, Präferenzen und Vorurteilen geprägt sind, besteht die Gefahr einer Echo-Kammer, in der die KI vor allem bestätigt, was wir bereits denken oder erwarten, statt uns herauszufordern und neue Perspektiven aufzuzeigen.

Damit wird der befreiende Aspekt der Erweiterung durch Technologie eingeschränkt und das Denken kann auf bestehende Sichtweisen verengt bleiben. Um die Vorteile von LLMs für unser kognitives Handeln optimal zu nutzen und zugleich die Risiken zu minimieren, ist eine neue Form von kognitiver Wachsamkeit gefragt. Wir müssen uns bewusst sein, dass unsere erweiterten Denkpartner zwar effizient und kreativ unterstützen, aber keine unveränderlichen Wahrheiten liefern. Die kritische Reflexion muss sich deshalb vertiefen und neben reiner Faktenprüfung auch die Analyse von Bias, Argumentationsstrukturen und zugrundeliegenden Weltanschauungen einschließen. Nur so kann der erweiterte Geist zu einer echten Bereicherung unseres Denkens werden und nicht zu einer unkritischen Übernahme fremder Perspektiven führen.

Das Konzept des erweiterten Geistes eröffnet dabei nicht nur ein Verständnis dafür, wie sich unser Denken mit externen Tools vermischt, sondern fordert uns auch auf, diese Verbindung aktiv und verantwortungsvoll zu gestalten. Indem wir Technologien als Partner in unserem Denken begreifen, entstehen neue Möglichkeiten, kreative Ideen zu entwickeln, komplexe Probleme zu lösen und Wissen effizienter zu verarbeiten. Gleichzeitig müssen wir die mit dieser Integration verbundenen reflexiven Herausforderungen annehmen und die kritische Distanz wahren. In der Praxis bedeutet das, dass Nutzer von LLMs sich zunehmend Fähigkeiten aneignen sollten, die über reine Anwendungskompetenzen hinausgehen. Dazu zählen etwa ein vertieftes Bewusstsein für sprachliche Feinheiten, Kenntnisse über algorithmische Verzerrungen, sowie Strategien zur gezielten Förderung divergierender Meinungen im Dialog mit der KI.

Ebenso wichtig ist die Ausbildung eines gesunden Skeptizismus, der es erlaubt, überzeugende Ergebnisse nicht automatisch als verlässliche Fakten zu akzeptieren, sondern gezielt nach Evidenz und alternativen Erklärungen zu suchen. Darüber hinaus regen LLMs zur Reflexion über das eigene Denken an. Die Interaktion mit einer KI, die sowohl Spiegel als auch Herausforderer sein kann, macht bewusst, wie sehr der Mensch seine kognitiven Prozesse in Form von Sprache strukturiert und wie diese Struktur wiederum die Wahrnehmung der Welt beeinflusst. Hier entstehen Chancen für Selbstoptimierung, denn durch das Hinterfragen und Umgestalten der eigenen sprachlichen Ausdrucksweisen lassen sich Denkgewohnheiten flexibel anpassen und erweitern. Insgesamt steht die Gesellschaft mit der Verbreitung von Large Language Models und dem Konzept des erweiterten Geistes an einem Scheideweg.

Die Verschmelzung von biologischem Denken und maschineller Unterstützung eröffnet bisher ungeahnte Möglichkeiten, unser Wissen zu erweitern und komplexe Probleme kreativer zu bewältigen. Gleichzeitig verlangt sie ein hohes Maß an kritischer Kompetenz und Bewusstsein, um den Einfluss systematischer Verzerrungen und manipulativer Sprachstrukturen zu erkennen und sich nicht von ihnen leiten zu lassen. Dieser Balanceakt wird entscheidend dafür sein, wie das zukünftige Zusammenspiel zwischen Mensch und Maschine gestaltet wird. Die bewusste Kontrolle über unsere erweiterten geistigen Fähigkeiten ermöglicht es, die Vorteile der Künstlichen Intelligenz intelligent und ethisch verantwortungsvoll zu nutzen – und somit eine neue Phase des Denkens einzuleiten, die sowohl produktiv als auch reflektiert ist.