Die rasante Entwicklung von Künstlicher Intelligenz (KI) führt dazu, dass sich immer mehr Technologien eigenständig weiterentwickeln. Insbesondere im Bereich der Softwareentwicklung erleben wir derzeit eine Revolution durch den Einsatz von großen Sprachmodellen – sogenannten Large Language Models (LLMs). Diese Tools haben das Potenzial, nicht nur Programmierern bei der Code-Erstellung zu helfen, sondern auch sich selbst zu verbessern und ihren eigenen Code zu optimieren. Dieses faszinierende Phänomen weist auf eine völlig neue Dimension der Automatisierung hin, die den Software-Entwicklungsprozess nachhaltig verändern könnte. Große Sprachmodelle wie GPT-4 von OpenAI oder vergleichbare Systeme besitzen eine gewaltige Fähigkeit, natürliche Sprache zu verstehen und zu generieren.

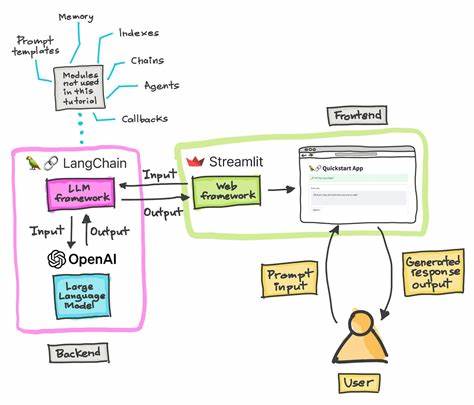

Entwickler finden in ihnen intelligente Assistenten, die Code analysieren, Fehler erkennen, Vorschläge zur Verbesserung bieten und sogar vollständige Programmierabschnitte schreiben können. Was jedoch noch spannender ist, ist die Fähigkeit mancher KI-basierter Werkzeuge, nicht nur passiv zu unterstützen, sondern aktiv ihren eigenen Algorithmus oder Code eigenständig zu überarbeiten und zu verfeinern. Die zugrundeliegende Technologie beruht auf sogenanntem "Self-Improvement" von KI. Dabei können Programmwerkzeuge anhand von Rückmeldungen, Fehleranalysen oder neuen Zielvorgaben ihren eigenen Code adaptiv umstrukturieren. Dies geschieht mit einer Kombination aus maschinellem Lernen, Reinforcement Learning und natürlich den linguistischen Fähigkeiten, die LLMs mitbringen.

Der große Vorteil ist, dass die KI durch diesen lernenden Prozess effizientere, fehlerfreie und performantere Lösungen generieren kann, ohne dass ein menschlicher Entwickler jeden Schritt vorgeben muss. Ein entscheidender Faktor für den Erfolg solcher Systeme ist die kontinuierliche Überwachung und Evaluierung des generierten Codes. Die Programme führen häufig automatisierte Tests durch, vergleichen neue Codeversionen mit älteren, führen Benchmark-Analysen aus und lassen sich anhand von Metriken wie Laufzeit, Speicherverbrauch oder Lesbarkeit bewerten. Dieser iterierende Prozess ermöglicht es der KI, Schwachstellen zu identifizieren und gezielt Verbesserungen einzubauen. Besonders in komplexen Projekten mit hohen Anforderungen an Qualität und Performance bieten diese Tools einen unschätzbaren Mehrwert.

Die Softwareentwicklung wird dadurch spürbar effizienter, denn Entwickler können sich auf wesentlich kreativere und konzeptionelle Aufgaben konzentrieren anstatt auf Routinearbeit oder Debugging. Gleichzeitig sinkt die Fehlerquote im Code, da die KI gängige Fallstricke erkennt und vermeidet. Die Arbeit mit LLM-basierten Programmierassistenten wird dadurch nicht nur produktiver, sondern auch sicherer. Die Kombination aus menschlichem Fachwissen und KI-gestützter Selbstoptimierung sichert eine neue Qualitätsstufe bei Softwareprodukten. Eine weitere spannende Anwendung ist die automatische Anpassung an wechselnde Anforderungen.

Im Softwarelebenszyklus ändern sich Anforderungen oder Zielvorgaben mitunter häufig. Mit herkömmlichen Methoden bedeutet dies meist hohen manuellen Aufwand. LLM-basierte Werkzeuge, die ihren eigenen Code verbessern, können schnell reagieren, den Code reorganisationieren und neu ausrichten. Die Zeit zwischen Anforderung und Umsetzung wird deutlich verkürzt, was gerade in agilen Entwicklungsumgebungen einen erheblichen Wettbewerbsvorteil bietet. Die Selbstverbesserung im Code durch LLMs hat jedoch auch Herausforderungen.

Zum einen ist die Transparenz des KI-Entscheidungsprozesses oft begrenzt, was die Nachvollziehbarkeit erschwert. Entwickler müssen darauf achten, dass sie den automatischen Änderungen vertrauen können und die Kontrolle über kritische Codeabschnitte behalten. Zum anderen besteht die Gefahr, dass sich Fehler oder unerwünschte Verhaltensmuster unbemerkt reproduzieren, wenn die KI-Modelle nicht ausreichend trainiert oder überwacht werden. Datenschutz und Sicherheit sind weitere wichtige Themen. Insbesondere wenn der selbstoptimierende Code in sicherheitskritischen Bereichen wie Medizin, Finanzen oder autonomen Systemen eingesetzt wird, sind rigorose Prüfungen unverzichtbar.

Die Kombination aus menschlicher Expertise und automatisierter KI-Unterstützung bleibt daher unerlässlich, um Risiken zu minimieren. Trotz der genannten Herausforderungen eröffnet die Fähigkeit von LLM-basierten Werkzeugen, ihren eigenen Code zu verbessern, faszinierende Perspektiven für die Zukunft der Softwareentwicklung. Unternehmen können durch diese Innovationen Entwicklungszeiten verkürzen, Kosten senken und qualitativ hochwertige Produkte schneller auf den Markt bringen. Gleichzeitig fördern sie einen kreativeren und produktiveren Entwicklungsprozess, der Entwickler entlastet und Raum für Innovation schafft. Ausblickend ist davon auszugehen, dass die Integration von Selbstlern- und Selbstverbesserungsmechanismen in Programmierwerkzeuge weiter zunehmen wird.