Die Food and Drug Administration (FDA), die wichtigste Behörde für die Zulassung von Arzneimitteln in den Vereinigten Staaten, befindet sich aktuell in Gesprächen mit OpenAI, einem führenden Unternehmen im Bereich künstlicher Intelligenz (KI). Diese Gespräche zielen darauf ab, den Einsatz von KI-Technologien im komplexen und vielfach kritisierten Prozess der Arzneimittelbewertung zu erforschen und zu etablieren. Während die FDA traditionell für ihre gründlichen und oft langwierigen Prüfungen bekannt ist, könnte die Integration von KI hier für eine signifikante Beschleunigung sorgen, ohne die Sicherheit und Wirksamkeit der Medikamente zu kompromittieren. Das Thema hat damit enormes Potenzial, sowohl den Gesundheitssektor als auch Patienten weltweit zu beeinflussen. Eine der zentralen Herausforderungen bei der Arzneimittelentwicklung ist die enorm lange Dauer bis zur Markteinführung neuer Therapien.

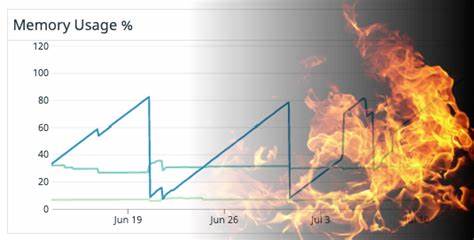

Der Entwicklungs- und Zulassungsprozess kann mehr als ein Jahrzehnt dauern. Die FDA-Kommissar Marty Makary hat öffentlich die Frage gestellt, warum die Branche bei der Zulassung neuer Medikamente nicht moderner vorgeht und warum Technologien wie KI bisher nicht umfassend genutzt wurden, um Verzögerungen zu verringern. Anlässlich eines Treffens der American Hospital Association verdeutlichte Makary, dass die Behörde erste Schritte unternommen hat und bereits eine erste AI-unterstützte wissenschaftliche Bewertung abgeschlossen wurde. Dies gilt als Anfang einer Reihe von Maßnahmen zur Nutzung von KI im Zulassungsprozess. Ein zentrales Projekt in diesem Zusammenhang trägt den Namen cderGPT, wobei „CDER“ für Center for Drug Evaluation and Research steht, die FDA-Abteilung, die für die Regulation von verschreibungspflichtigen und rezeptfreien Arzneimitteln zuständig ist.

cderGPT soll offenbar KI-basierte Werkzeuge integrieren, die den Review-Prozess effizient unterstützen. Laut mehreren Quellen, die mit den Vorgängen vertraut sind, hat bisher ein kleines Team von OpenAI mit der FDA und weiteren Beteiligten Gespräche geführt. Darunter befinden sich auch Personen, die mit Initiativen von Elon Musk verbunden sind, insbesondere mit dem sogenannten Department of Government Efficiency. Jeremy Walsh, erst kürzlich als erster KI-Beauftragter der FDA ernannt, steht an der Spitze dieser Verhandlungen und koordiniert die Bemühungen, geeignete KI-Anwendungen im Arzneimittelprüfungsprozess zu identifizieren und umzusetzen. Begleitend zu diesen Entwicklungen steht der junge Peter Bowman-Davis, der als stellvertretender Chief AI Officer am Department of Health and Human Services (HHS) tätig ist.

Bowman-Davis, der sich momentan im Studienurlaub von der Yale Universität befindet, gehört dem Team American Dynamism von Andreessen Horowitz an und spielt ebenfalls eine Schlüsselrolle bei der Ausgestaltung der KI-Strategien innerhalb der Regierung. Während OpenAI sich zu den Verhandlungen bisher nicht geäußert hat, zeigt das Interesse der FDA exemplarisch, wie wichtig der Einsatz von KI in hochregulierten Bereichen wie der Arzneimittelentwicklung inzwischen eingeschätzt wird. Angesichts der Komplexität der Daten und Anforderungen in der Arzneimittelforschung erwarten Experten, dass KI vor allem bei Routineaufgaben wertvolle Dienste leisten kann. Dazu zählen beispielsweise die automatische Überprüfung von Antragsunterlagen auf Vollständigkeit, was bislang manuell erfolgt und viel Zeit in Anspruch nimmt. Die Automatisierung solcher „low-hanging fruits“ könnte den Austausch zwischen Antragstellern und Behörde beschleunigen und so die Bearbeitungszeiten reduzieren.

Gleichzeitig warnen Fachleute davor, den Einsatz von KI unkritisch zu betrachten. KI-Modelle sind zwar in der Lage, komplexe Informationen zu verarbeiten, neigen aber auch dazu, plausible, aber falsche Informationen zu generieren – das sogenannte „Halluzinieren“. Eine ehemalige FDA-Mitarbeiterin, die Erfahrung mit ChatGPT in klinischen Anwendungen gesammelt hat, hebt hervor, dass die Zuverlässigkeit solcher Systeme bei wichtigen Prüfaufgaben noch nicht endgültig bewertet werden kann. Daraus ergibt sich die Notwendigkeit strenger Kontrollen, genauer Validierungen und klarer Richtlinien, bevor KI-Systeme in entscheidenden Bewertungsverfahren eingesetzt werden. Ein weiterer wichtiger Aspekt betrifft die Trainingsdaten, die für die Entwicklung der KI-Modelle verwendet werden.

Experten wie Rafael Rosengarten, CEO von Genialis und Mitglied der Alliance for AI in Healthcare, fordern klare Regelungen, welche Datenquellen zulässig sind und welche Qualitätsstandards bei der Modellleistung erfüllt sein müssen. Nur so kann gewährleistet werden, dass die KI korrekte und relevante Informationen lernt, um angemessene Empfehlungen zu geben. Dabei steht die Transparenz gegenüber Patienten und Gesundheitsexperten im Vordergrund, um Vertrauen in die neue Technologie aufzubauen. Die FDA nutzt bereits jetzt verschiedene Instrumente, um den Prozess der Arzneimittelzulassung zu beschleunigen. Programme wie der Fast Track oder die Breakthrough Therapy wurden entwickelt, um vielversprechende Medikamente mit großem Patientennutzen schneller zur Marktreife zu bringen.

Die Integration von KI könnte die Effektivität solcher Programme weiter steigern, indem man schneller relevante Daten identifiziert und analysiert, ohne die umfassenden Sicherheitsprüfungen aufzuweichen. Parallel zu den Verhandlungen mit OpenAI betreibt die FDA auch eigene Forschungsprojekte zur Anwendung großer Sprachmodelle (LLMs) im Gesundheitsbereich. So wurde im Dezember 2023 eine Forschungsstelle ausgeschrieben, die sich mit der Entwicklung und Anwendung von LLMs für den Bereich der Präzisionsmedizin, Arzneimittelentwicklung und Regulierungswissenschaft beschäftigen soll. Dieses Engagement verdeutlicht, wie ernst die Behörde die vielversprechenden Potenziale von KI einschätzt und gleichzeitig einen eigenen Forschungs- und Entwicklungsweg beschreitet. OpenAI hat zudem kürzlich die selbstgehostete Variante ChatGPT Gov vorgestellt, die speziell den Anforderungen von Behörden entsprechen soll.

Dieses Produkt ist mit Blick auf Sicherheits- und Datenschutzanforderungen der öffentlichen Hand konzipiert und könnte deshalb auch die Voraussetzung für die Verarbeitung sensibler Daten im regulatorischen Umfeld bieten. Derweil arbeitet OpenAI daran, für ihr Unternehmensprodukt ChatGPT Enterprise entsprechende FedRAMP-Zertifikate zu erhalten, was für den Umgang mit Regierungsdaten eine Pflicht ist. Die Aufregung rund um das Thema KI in der Arzneimittelbewertung ist nur ein Teil der größeren Debatte darüber, wie künstliche Intelligenz das Gesundheitswesen revolutionieren kann. Es zeigt sich, dass der regulatorische Rahmen zwar herausfordernd ist, aber durch die enge Zusammenarbeit von Technologieunternehmen und staatlichen Stellen innovative Lösungen entstehen könnten. Sowohl potenzielle Chancen als auch Risiken werden derzeit intensiv abgewogen.

Zukunftsvisionen gehen dahin, dass KI nicht nur die Effizienz in der Bearbeitung von Zulassungsanträgen erhöht, sondern auch bei der Identifikation neuer Wirkstoffe, Simulation von Studienergebnissen oder personalisierter Medizin eine zentrale Rolle spielt. Damit einhergehend müssten jedoch auch Fragen der Haftung, ethischen Verantwortung und der Patientenorientierung geklärt werden. Die aktuelle Zusammenarbeit zwischen OpenAI und der FDA kann deshalb als Meilenstein betrachtet werden, der den Anfang eines neuen Zeitalters in der Arzneimittelentwicklung und -bewertung markiert. Mit intelligenten Algorithmen könnten regulatorische Prozesse schneller, sicherer und transparenter gestaltet werden. Patienten könnten dadurch früher Zugang zu lebenswichtigen Innovationen erhalten, während gesundheitspolitische Institutionen ihre Ressourcen effizienter einsetzen können.

Es bleibt abzuwarten, wie sich die Gespräche konkret ausprägen und ob bald eine offizielle Kooperation oder ein Vertragsabschluss erfolgt. Unabhängig davon illustriert die Initiative, wie eng und interdisziplinär Technologie und Gesundheitspolitik zunehmend zusammenwachsen. Für die Öffentlichkeit ist es wichtig, diese Fortschritte aufmerksam zu begleiten und kritisch zu hinterfragen, um den größtmöglichen Nutzen der Technologie unter Wahrung von Sicherheit und Vertrauen zu erzielen.