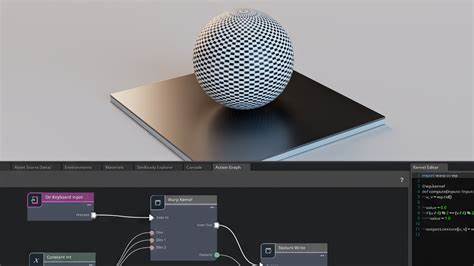

Die Welt der Computergrafik entwickelt sich stetig weiter und neue Technologien sorgen dafür, dass komplexe grafische Darstellungen immer zugänglicher und effizienter werden. Eine dieser bemerkenswerten Innovationen ist die 3D Gaussian Splatting-Technik, die sich durch ihre Fähigkeit auszeichnet, dreidimensionale Punktewolken präzise und visuell ansprechend darzustellen. Mit der jüngsten Implementierung in Nvidia Warp gibt es nun eine Möglichkeit, diese Technik in einer sauberen, minimalistischen Codebasis zu erforschen und gleichzeitig von der Flexibilität und Leistung moderner Hardware zu profitieren – egal ob auf CPU oder GPU. Diese Entwicklung eröffnet neue Wege für Forschung, Lehre und praktische Anwendungen in der Computergrafik und maschinellen Lernen. 3D Gaussian Splatting ist eine Methode zur Darstellung von 3D-Szenen, die sich hauptsächlich auf die Verwendung von Gauss'schen Verteilungsfunktionen (auch Gaussians genannt) stützt.

Diese werden verwendet, um Punkte in einem dreidimensionalen Raum visuell repräsentativ zu machen, indem jedem Punkt eine Art unscharfer Schein verliehen wird, wodurch detailreiche und dennoch weiche Darstellungen entstehen. Dieses Verfahren wird besonders für Anwendungen interessant, bei denen es auf realistische, differenzierbare Rendering-Verfahren ankommt – etwa in der Rekonstruktion von 3D-Objekten, Augmented Reality oder in neuralen Rendering-Modellen. Die neue Umsetzung von 3D Gaussian Splatting mit Nvidia Warp stellt eine Revolution dar, weil sie eine einfache, verständliche und minimalistische Codebasis bereitstellt, die sowohl auf CPUs als auch GPUs laufen kann. Nvidia Warp ist eine moderne Programmierinfrastruktur, die es erlaubt, parallele Berechnungen mit nur geringem Aufwand auf unterschiedliche Hardware zu portieren. Der bedeutende Vorteil ist hierbei, dass Entwickler sich nicht mehr mit komplizierten CUDA-Kernel-Programmierungen und gerätespezifischem Code auseinandersetzen müssen.

Stattdessen sorgt Warp dafür, dass dieselben Kernfunktionen auf CPUs und GPUs ausgeführt werden können, indem lediglich eine Konfiguration geändert wird. So entfallen viele technische Hürden, die sonst den Einstieg und die Entwicklung behindern. Diese Implementierung im Python-Ökosystem spricht vor allem Entwickler und Forschende an, die moderne Grafiktechniken lernen möchten, ohne sich durch unübersichtlichen und schwergewichtigen Code kämpfen zu müssen. Der Ansatz ist bewusst minimalistisch gestaltet und verzichtet auf unnötige Komplexität. Zum Beispiel sind Forward- und Backward-Pass, die zentrale Schritte in vielen differenzierbaren Renderingsystemen darstellen und die in bisherigen Lösungen oft extrem komplex und fehleranfällig waren, hier klar gegliedert und überschaubar umgesetzt.

Das macht es einfacher, den zugrunde liegenden Algorithmus zu verstehen und bei Bedarf anzupassen. Ein weiterer Pluspunkt der Nvidia Warp-Integration ist die einfache Installation und Nutzung. Alle Abhängigkeiten können über gängige Python-Pakete installiert werden, und es bedarf keiner komplizierten CUDA-Konfiguration. Neben Warp kommen bekannte Bibliotheken wie NumPy, Matplotlib und sogar PyTorch zum Einsatz, was die Einbindung in bestehende Machine Learning-Prozesse vereinfacht. Dies ist sowohl für Einsteiger als auch für erfahrene Entwickler von Bedeutung, die schnell Prototypen erstellen oder sich mit aktuellen Forschungsthemen auseinandersetzen wollen.

Die Anwendungsmöglichkeiten dieser Technologie sind vielfältig. Besonders spannend ist der Einsatz im akademischen Bereich, wo das Verständnis von differentiable Rendering und paralleler Grafikberechnung immer wichtiger wird. Schülerinnen und Schüler oder Studierende können an praktischen Beispielcodes die zugrundeliegenden Konzepte nachvollziehen, ohne von der Komplexität großer Frameworks erschlagen zu werden. Gleichzeitig lassen sich mit der Technologie hochwertige 3D-Datenvisualisierungen realisieren, die nicht nur wissenschaftlich relevant sind, sondern auch ästhetisch überzeugen. Zusätzlich bietet die Implementierung praktische Trainings- und Render-Skripte, die es erlauben, direkt mit realen Daten wie dem bekannten Lego-Datensatz zu arbeiten.

Dieser Datensatz dient als Benchmark und ermöglicht es, das Verhalten der Algorithmen unter realistischen Bedingungen zu beobachten. Das Render-Skript zeigt beispielsweise, wie wenige Gaussians schon eine ansprechende Visualisierung erzeugen können. Das Training wiederum demonstriert die Anpassung der Parameter an die Daten, wodurch ein besseres Verständnis der Optimierungsprozesse vermittelt wird. Trotz aller Transparenz und Einfachheit ist die Performance des Systems kaum vernachlässigbar. Dank Warp kann man die Berechnungen parallel auf modernen Grafikkarten nutzen, was die Geschwindigkeit gegenüber rein CPU-basierten Programmen deutlich erhöht.

Gleichzeitig ist die Implementierung so konzipiert, dass sie auf weniger leistungsfähiger Hardware problemlos funktioniert, was den Zugang zu moderner 3D-Grafiktechnik erheblich demokratisiert. Natürlich gibt es, wie bei jeder neuen Implementierung, noch Potenzial für Verbesserungen. Die Entwickler betonen, dass die aktuelle Version vor allem auf korrekte Funktionalität und Nachvollziehbarkeit ausgerichtet ist und weniger auf maximale Geschwindigkeit. Künftige Versionen könnten durch gezielte Warp-Kernel-Optimierungen noch schneller werden. Außerdem fehlt es derzeit an einer ausgefeilten Methode zur Sichtbarkeitsprüfung und zum Herausfiltern inaktiver Punkte, was bei sehr großen Datensätzen die Renderqualität und Effizienz verbessern würde.

Insgesamt bietet die 3DGS-Reimplementierung in Nvidia Warp einen starken Impuls für die Computergrafik-Community. Sie verbindet modernste Technologien mit einem zugänglichen, offenen und gut dokumentierten Projekt, das sowohl Lernen als auch Innovation fördert. Durch die nahtlose Funktionalität auf CPU und GPU, den Verzicht auf komplexes Setup und die klare Codebasis ist sie eine ideale Plattform für alle, die in die Welt von differentiable Rendering und 3D-Gaussian-Splatting eintauchen möchten. Dieser Ansatz ist auch ein hervorragendes Beispiel dafür, wie Softwareentwicklung immer stärker auf Nutzerfreundlichkeit und offene Forschung setzt und damit den Zugang zu komplizierten Technologien grundlegend erleichtert. Für Entwickler, Forscher, Studierende und Interessierte an moderner Computergrafik bietet dieses Projekt eine praxisnahe Möglichkeit, komplexe Verfahren zu verstehen und selbst aktiv zu gestalten.

Die Zukunft der 3D-Rekonstruktion und des differenzierbaren Renderings könnte durch Projekte wie diese entscheidend geprägt werden, die Brücken zwischen Theorie, Praxis und verschiedener Hardwarewelt schlagen. Abschließend zeigt die Integration von 3D Gaussian Splatting in Nvidia Warp, wie Synergien zwischen neuen Programmiermodellen und Grafikmethoden innovative Anwendungen ermöglichen. Wer sich für die Zukunft der Computergrafik interessiert, findet mit dieser Lösung ein attraktives, leistungsfähiges und motivierendes Werkzeug, das dazu einlädt, neue Wege zu beschreiten und die Grenzen des Machbaren auszuloten.