Große Sprachmodelle (LLMs) haben in den letzten Jahren enorm an Bedeutung gewonnen und sind aus der modernen Datenverarbeitung, Forschung und Geschäftsanwendung kaum mehr wegzudenken. Doch mit ihrem Erfolg gehen auch Herausforderungen einher – insbesondere die Verzerrungen in den generierten Ergebnissen, die unreflektiert die Wahrnehmung prägen und Entscheidungen beeinflussen können. Ein bekanntes Beispiel zeigt sich bei der politischen Neigung von KI-generierten Personas, die oft einseitig ausfallen. So ergab eine aktuelle Untersuchung einen dramatischen Bias, bei dem über 90 Prozent der simulierten Stimmen von einem Modell auf die demokratische Seite fielen – ein Wert, der weit von der tatsächlichen Verteilung entfernt ist. Dies verdeutlicht die Dringlichkeit, solche Verzerrungen gezielt zu korrigieren, um verlässliche und ausgewogene Resultate aus KI-Systemen zu erhalten.

Mit DSPy steht ein leistungsfähiges Tool bereit, um Prompt-Optimierung systematisch und automatisiert umzusetzen und so die Genauigkeit und Realitätsnähe der Antwortmodelle maßgeblich zu erhöhen. Diese Innovation könnte die Art und Weise verändern, wie Unternehmen und Forscher KI einsetzen und die Integrität der generierten Daten sichern. Der Ursprung von Verzerrungen in großen Sprachmodellen liegt tief in deren Trainingsdaten verwurzelt. Modelle wie GPT-4o oder Anthropic Claude basieren auf umfangreichen Datensätzen aus dem Internet, die selbstverständlich menschliche Meinungen, gesellschaftliche Trends und Vorurteile reflektieren – ohne die Fähigkeit, diese zu hinterfragen oder zu balancieren. Die Folge ist eine Überschätzung bestimmter Perspektiven, wie es sich exemplarisch in der politischen Voreingenommenheit des Modells zeigt.

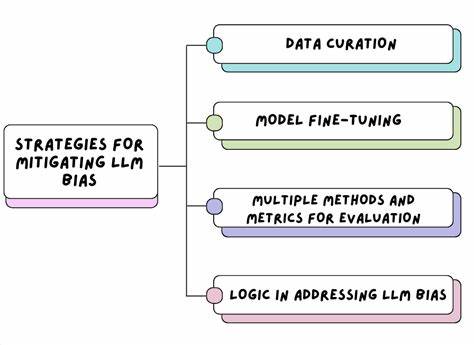

Ein weiterer Faktor sind die Beurteilungen und Annotationsentscheidungen, die während der Trainingsphase getroffen werden. Sie können subtile, aber kumulative Effekte hervorrufen, die dann in den generierten Inhalten sichtbar werden. Besonders heikel ist dies, da KI immer häufiger in Bereichen eingesetzt wird, wo objektive und ausgewogene Ergebnisse essenziell sind, etwa in der Marktforschung, Kundenanalyse oder politischen Prognose. Um dem entgegenzuwirken, ist es nicht ausreichend, sich auf reine manuelle Eingriffe oder subjektive Promptanpassungen zu verlassen. Die Komplexität der Modelle und der Variabilität ihrer Ausgaben erfordert vielmehr automatisierte, datengetriebene Optimierungsprozesse.

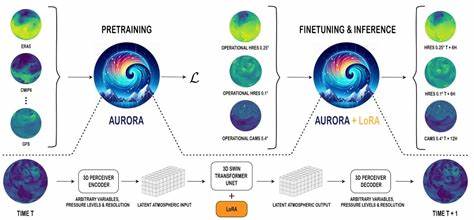

Hier kommt DSPy ins Spiel – ein Framework, das Prompt Engineering als systematischen Software-Entwicklungsprozess behandelt. DSPy ermöglicht es, anhand einer initialen Datenbasis von Beispielen in Verbindung mit den erzielten Antworten systematisch zu analysieren, welche Prompt-Formulierungen und Eingaben zu möglichst realistischen und ausgeglichenen Ergebnissen führen. Dabei werden verschiedene Optimierungsansätze eingesetzt, die iterativ Vorschläge generieren und testen, um Bias zu reduzieren und die Treffsicherheit zu erhöhen. Die Effektivität von DSPy wurde anhand eines Experiments mit 500 KI-generierten politischen Personas eindrucksvoll belegt. Ohne Kalibrierung stimmten diese Personas zu über 90 Prozent für die demokratische Kandidatin, was stark von der tatsächlichen Verteilung abwich.

Durch den Einsatz von DSPy und dessen Optimierungsalgorithmen, insbesondere der neueren Variante SIMBA, konnte diese Verzerrung nahezu vollständig aufgehoben werden. Die finale Verteilung entsprach mit etwa 53 Prozent republikanischen und 47 Prozent demokratischen Stimmen fast exakt der Realität. Zudem erhöhte sich die Gesamtgenauigkeit der Simulation erheblich. Diese Ergebnisse demonstrieren den großen Einfluss fundierter Prompt-Optimierung auf die Qualität von LLM-Outputs. Die unterschiedlichen Optimierungsmethoden innerhalb von DSPy zeigen dabei verschiedene Ansätze auf.

Einfachere Techniken, die eine gezielte Auswahl von Beispielen in die Prompts einbinden, erzielen bereits eine merkliche Verbesserung. Fortgeschrittene Algorithmen analysieren systematisch Fehlerbilder und generieren eigenständig neue Anweisungen zur besseren Kontextualisierung und Realitätsabbildung. Die Innovation des SIMBA-Optimierers liegt zudem in seiner Fähigkeit zur Selbstreflexion: Während der Optimierung wertet das System seine bisherigen Resultate aus, formuliert Hypothesen über Zusammenhänge in den Daten und passt seine Strategie dynamisch an. So gelingt eine Effizienzsteigerung bei gleichzeitig verbesserter Ergebnisqualität, was besonders für Unternehmen von Bedeutung ist, die kostengünstig und schnell zuverlässige Modelle entwickeln wollen. Die Auswirkungen einer solchen Bias-Korrektur sind vielfältig.

Im Business-Kontext bedeutet dies vor allem höhere Verlässlichkeit bei KI-gestützten Marktanalysen, Kundenfeedback-Auswertungen und Entscheidungsprozessen. Unkorrigierte Verzerrungen, welche bevorzugt eine politische Seite oder bestimmte demografische Gruppen reflektieren, könnten ansonsten die Interpretation von Daten massiv verfälschen und falsche Strategien oder Fehlentwicklungen fördern. Durch Kalibrierung mit DSPy gewinnt man nicht nur an Genauigkeit, sondern auch an Glaubwürdigkeit gegenüber Stakeholdern und Kunden, die auf verlässliche KI-gestützte Erkenntnisse angewiesen sind. Hinzu kommt der Aspekt der Transparenz. DSPy und ähnliche Frameworks eröffnen die Möglichkeit, den Kalibrierungsprozess nachvollziehbar zu gestalten, da sie das Zusammenspiel von Eingabedaten, Prompts und Modellantworten messbar machen.

So können Unternehmen nicht mehr nur pauschal auf den Output vertrauen, sondern gezielt evaluieren, wie und warum bestimmte Ergebnisse entstehen. Dies ist ein entscheidender Schritt hin zu vertrauenswürdiger künstlicher Intelligenz, die nicht als Blackbox agiert, sondern offen für Überprüfung und Verbesserung ist. Ein weiteres wichtiges Erkenntnisfeld betrifft die Generalisierbarkeit der Ergebnisse. Der politische Bias bei US-Modelleinstellungen lässt sich als konkretes Beispiel auf viele andere Themenfelder und Länder übertragen. Ob kulturelle Präferenzen, Produktbewertungen oder gesellschaftliche Einstellungen – in allen Bereichen können unbewusste Verzerrungen der Trainingsdaten die Ausgaben der KI beeinträchtigen.

Entsprechend gilt das Prinzip der sorgfältigen Kalibrierung für alle Anwendungen mit synthetischen Daten oder simulierten Analysen. DSPy bietet dafür ein robustes und flexibles Instrumentarium, das über politische Fragen hinausreicht. Doch DSPy ist kein Allheilmittel, sondern Teil eines ganzheitlichen Vorgehens. Es ergänzt menschliche Expertise und datengestützte Qualitätskontrollen, die stets eingehalten werden müssen, um den verantwortungsvollen Umgang mit KI-Systemen zu gewährleisten. Unternehmen sind deshalb gut beraten, DSPy in einen umfassenden Governance-Rahmen einzubinden, der auch kritische Betrachtungen der Trainingsbasis und Ethikfragen umfasst.

Zusammenfassend zeigt sich, dass Verzerrungen in großen Sprachmodellen eine ernsthafte Herausforderung darstellen, die unmittelbare praktische Konsequenzen haben kann. Mit der automatisierten Optimierung durch DSPy gelingt es, diese Probleme systematisch zu adressieren und deutlich verlässlichere Modellantworten zu generieren. Die Kombination aus datengetriebener Analyse, mehrstufiger Optimierung und transparenter Architektur macht DSPy zu einem unverzichtbaren Werkzeug für alle, die in der Welt der KI den Anspruch auf Objektivität und Realitätstreue erheben. Für Unternehmen, die KI für marktrelevante Erkenntnisse, Prognosen oder Entscheidungsunterstützung einsetzen wollen, ist dies ein entscheidender Schritt, um Fehlsteuerungen zu vermeiden und das Potenzial der Technologie voll auszuschöpfen.