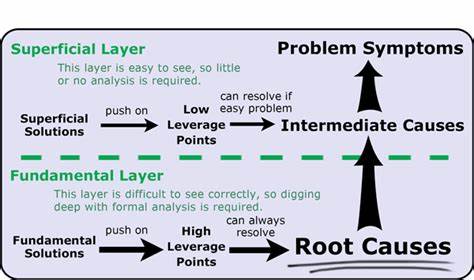

In unserer zunehmend vernetzten und technologiegetriebenen Welt werden Systeme immer komplexer. Gerade in Bereichen wie Softwareentwicklung, Sicherheitsmanagement und industriellen Abläufen zeigt sich, dass die traditionelle Vorstellung von Fehlern als einfach durch Ursachenketten erklärbare Ereignisse nicht mehr genügt. Ein tieferes Verständnis komplexer Systeme legt nahe, dass es weniger klare lineare Kausalketten gibt, sondern vielmehr ein Geflecht von Interaktionen und ständigen Anpassungen, die zu Vorfällen oder Fehlern führen können. Dieses Umdenken ist fundamental für effektives Incident Management, Resilienzförderung und kontinuierliche Verbesserung. Die Grenzen der traditionellen Ursachenanalyse Viele Organisationen bedienen sich der sogenannten Root Cause Analysis (RCA), um herauszufinden, warum ein Vorfall eingetreten ist.

Bei der RCA wird oft nach einer einzelnen, ursächlichen Ursache gesucht, die – so die Annahme – durch das Beseitigen dieser Ursache künftige Probleme verhindert. Dieses Vorgehen basiert auf der Vorstellung einer linearen Kausalkette, vergleichbar mit fallenden Dominosteinen – wenn man den ersten Stein entfernt, fällt die Kette nicht mehr. Während dieses Modell in einfacheren Kontexten gut funktioniert, erreicht es bei komplexen, sich dynamisch verändernden Systemen seine Grenzen. Komplexe Systeme zeichnen sich durch zahlreiche miteinander verknüpfte Komponenten aus, die in unvorhersehbarer Weise interagieren. In solchen Umgebungen ist es kaum möglich, eine einzige Ursache für ein Problem zu identifizieren.

Stattdessen sind es oft mehrere Faktoren, die zusammenspielen, und die genau in dem Augenblick zusammenkommen, an dem ein Vorfall auftritt. Die Fixierung auf einen vermeintlichen Hauptverursacher übersieht dabei, dass sich das System in einem ständigen Zustand der Anpassung befindet und dass Fehler und unerwartete Ereignisse als Produkt dieser tiefgreifenden und oft unbekannten Wechselwirkungen entstehen. Interaktionen als Herzstück komplexer Vorfälle Anstelle der bisherigen Denkweise, Ursachen linear zu verfolgen, schlägt das Konzept der Resilience Engineering (RE) vor, den Fokus auf die Interaktionen zwischen Systemkomponenten zu legen. Es geht darum zu verstehen, wie sich unterschiedliche Bausteine eines Systems gegenseitig beeinflussen und wie diese Wechselwirkungen zum Entstehen von Fehlern führen können. Dabei existiert keine einfache Kette von Ereignissen, sondern vielmehr ein Netzwerk von Einflussfaktoren, das sich ständig verzweigt und verändert.

Diese Perspektive erkennt an, dass keine einzelne Komponente isoliert betrachtet werden kann. Eine Komponente, die in einem Kontext einwandfrei funktioniert, kann in Kombination mit einer anderen zu unerwarteten Ergebnissen führen. Solche Interaktionen sind schwer vorhersehbar, denn sie entstehen aus komplexen Feedback-Schleifen, dynamischen Bedingungen und variierenden Eingangsgrößen – wie es beispielhaft bei modernen Software-Systemen, etwa Kubernetes, zu beobachten ist. Fehlfunktionen oder Vorfälle können so als „perfekte Stürme“ aus unerwarteten Wechselwirkungen interpretiert werden, deren einzelne Ursachen erst im Zusammenspiel relevant werden. Die Rolle der Anpassung im Umgang mit Fehlern Ein weiterer wesentlicher Aspekt komplexer Systeme ist ihre Fähigkeit zur Anpassung.

Systeme sind selten statisch; sie verändern sich ständig, passen sich an neue Bedingungen an und reagieren auf Störungen. Menschen und technische Systeme entwickeln Strategien, um trotz vorhandener Fehler weiterhin zu funktionieren. Dies wird als adaptive Kapazität bezeichnet und ist eine zentrale Säule der Resilienz. Das bedeutet auch, dass Fehler und Latent Failures (verborgene Schwachstellen) überall im System existieren, ohne dass sie sofort spürbar werden. Systeme arbeiten häufig im „degradierten Modus“ und schaffen es dennoch, ihre Funktionen trotz zahlreicher latenter Fehler aufrechtzuerhalten.

Die Herausforderung liegt darin, diese Anpassungsprozesse zu verstehen, zu unterstützen und auszubauen, anstatt nur einzelne Fehler zu suchen und zu eliminieren. Dieser Ansatz verändert auch die Herangehensweise an Vorfallsuntersuchungen. Anstatt nach Schuldigen oder Gründen zu suchen, die „falsch“ gehandelt haben, sollten Organisationen analysieren, wie Menschen und Systeme üblicherweise mit Problemen umgehen und welche Umstände dazu geführt haben, dass diese Bewältigungsstrategien diesmal nicht ausreichten. Ein tieferes Verständnis dieser Anpassungen erlaubt es, die Resilienz des Systems insgesamt zu stärken. Warum Root Cause Analysis in komplexen Kontexten an ihre Grenzen stößt Die klassische RCA, so hilfreich sie in einfachen, kausal klaren Situationen sein mag, basiert auf mehreren problematischen Annahmen für komplexe Systeme.

Erstens postuliert sie, dass es eine begrenzte Anzahl von Ursachen gibt, die wiederholt zu ähnlichen Vorfällen führen. Zweitens geht sie davon aus, dass die Eliminierung dieser Ursachen künftige Vorfälle verhindert. Und drittens fokussiert sie auf Ursachenbehebung statt auf die Stärkung der Fähigkeit des Systems zur Anpassung. In komplexen Systemen sind jedoch latent vorhandene Fehler über das gesamte System verteilt und verändern sich ständig. Die Ursachen für Vorfälle sind daher dynamisch und meistens einmalig in ihrer Zusammensetzung.

Das Entfernen eines einzelnen Fehlers sorgt kaum dafür, dass ähnliche oder verwandte Vorfälle nicht wieder auftreten – sie manifestieren sich einfach in neuen Konstellationen. Der Versuch, einzelne „Wurzeln“ aus dem System zu entfernen, kann zudem unerwartete neue Probleme erzeugen, wenn durch Änderungen neue Wechselwirkungen entstehen. Somit kann die Arbeit an isolierten Ursachen oft mehrschichtige Folgen haben, die wiederum neue Latent Failures erzeugen. Dieses Phänomen verdeutlicht die Notwendigkeit, nicht nur Fehler zu suchen und zu beheben, sondern vor allem die Fähigkeit der Systeme zu stärken, sich kontinuierlich an neue Herausforderungen anzupassen. Wie eine resilienzorientierte Sichtweise Organisationen voranbringt Der resilienten Perspektive folgend beginnt man, Vorfälle als Gelegenheiten zu verstehen, die adaptive Kapazität des Systems zu bewerten und zu stärken.

Statt ausschließlich nach Fehlerquellen zu suchen, erhöht man das Verständnis darüber, wie Arbeitsprozesse tatsächlich ablaufen, wie Menschen in Ausnahmesituationen reagieren, welche Kompensationsmechanismen existieren und wo diese Schwächen aufweisen. Aus dieser Sicht sind „menschliche Fehler“ keine Schuldzuweisungen, sondern Hinweise auf Grenzen der bestehenden Anpassungsstrategien. Diese Erkenntnis führt zu einem respektvollen Umgang mit den Handelnden und zu einem Fokus auf systemische Verbesserungen. Anpassungs- und Kompensationsmechanismen werden gezielt gefördert, damit das System auch in unerwarteten Situationen handlungsfähig bleibt. Darüber hinaus schafft dieser Ansatz eine offenere Lernkultur, in der sowohl Beinaheunfälle (Near Misses) als auch Probleme untersucht werden, bevor sie zu größeren Schäden führen.

Das Lernen aus kleinen Fehlern ist essentiell, da die Komplexität eines Systems unvorhersehbare Probleme wahrscheinlicher macht. Ein frühzeitiges Erkennen und Anpassen erhöht die Gesamtresilienz und verringert das Risiko gravierender Vorfälle. Beispiele aus Software und Sicherheitsmanagement In der Softwareentwicklung zeigt sich das Prinzip der Interaktionen und Anpassungen besonders deutlich. Systemkomponenten kommunizieren über mehrere Schichten und Protokolle, wobei das Verhalten einzelner Module häufig nur im Kontext sichtbar wird. Fehler können auftreten, wenn unerwartete Kombinationen von Eingaben oder Zuständen aufeinander treffen.

Die Praxis des Incident Managements verlagert sich daher weg vom Finden einzelner Fehlerquellen hin zu einer Analyse von Systeminteraktionen und betont die Bedeutung von Monitoring, Feedback-Loops und adaptiven Prozessen. Auch im Gesundheits- oder Arbeits- und Unfallschutz gewinnt diese Sichtweise an Bedeutung. Anstatt einen einzelnen Schuldigen zu suchen, wird untersucht, wie organisatorische, technische und menschliche Faktoren ineinandergreifen und welche Anpassungen in der täglichen Arbeit zu Vermeidung oder Steuerung von Risiken beitragen. Dies erleichtert eine ganzheitliche Risikobewertung und fördert eine Sicherheitskultur, die Fehler als Lernchancen begreift. Fazit: Ein Paradigmenwechsel für nachhaltige Systemverbesserung Der Umgang mit Vorfällen und Fehlern in komplexen Systemen erfordert ein Umdenken weg vom linearen Ursache-Wirkungs-Denken hin zu einer holistischen Betrachtung von Interaktionen und ständigen Anpassungen.