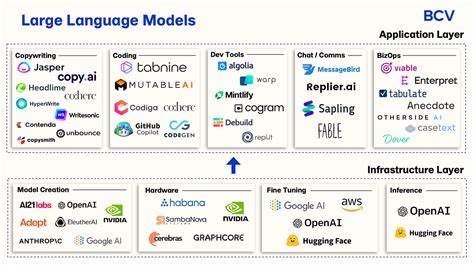

Mit dem rasanten Anstieg von Chatbots in verschiedenen Branchen und der steigenden Integration digitaler Kommunikationsmittel wächst auch die Bedrohung durch gezielte Cyberangriffe auf diese Plattformen. Eine bedeutende Sicherheitslücke wurde jüngst durch das bösartige Koishi Chatbot Plugin koishi-plugin-pinhaofa aufgedeckt, das Nachrichten exfiltriert, wenn diese eine bestimmte achtstellige hexadezimale Zeichenfolge enthalten. Diese Entdeckung unterstreicht die zunehmende Komplexität und das Risiko von Supply-Chain-Attacken im Bereich der Chatbot-Technologien. Koishi ist ein beliebtes TypeScript-Framework, das Entwicklern ermöglicht, Chatbots gleichzeitig auf mehreren Plattformen wie QQ, Telegram oder Discord zu betreiben. Die Flexibilität und Vielseitigkeit dieses Frameworks haben es zu einer bevorzugten Wahl für viele Unternehmen gemacht, insbesondere im Bereich des Kundenservice und E-Commerce.

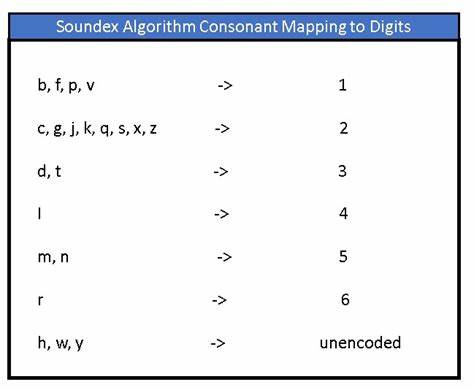

Doch gerade diese Offenheit birgt auch Gefahren, wenn Drittanbieter-Plugins wie koishi-plugin-pinhaofa ohne gründliche Prüfung in die Bots integriert werden. Das besagte Plugin wurde getarnt als ein Hilfsmittel zur Rechtschreibkorrektur angeboten, doch bei genauerer Analyse stellte sich heraus, dass es eine Datenexfiltrationsfunktion enthält. Konkret scannt das Plugin alle eintreffenden Nachrichten nach achtstelligen hexadezimalen Mustern, wie sie beispielsweise in Git-Commit-Hashes, JWT-Token oder Gerätenummern vorkommen können. Sobald ein solcher Code erkannt wird, sendet das Plugin die gesamte Nachricht an eine fest codierte QQ-Konto-ID in China. Diese Methode ist besonders heimtückisch, da achtstellige Hex-Zaheln häufig in legitimen Kontexten verwendet werden und somit das Plugin gezielt sensible Informationen auswählt, ohne viele Fehlalarme zu produzieren.

Dadurch ist der Angreifer in der Lage, hochrelevante Daten wie Passwörter, API-Schlüssel, Session-Tokens oder personenbezogene Informationen abzugreifen, ohne sofort Verdacht zu erregen. Die Sicherheitsforscher von Socket, die das Plugin entdeckten, hoben hervor, dass aufgrund der Architektur von Koishi alle Plugins im gleichen Prozess wie der Bot laufen. Das bedeutet, dass eine bösartige Erweiterung uneingeschränkten Zugriff auf die Nachrichten hat und sich nahtlos in die Kommunikationsstruktur einfügt. Da die Exfiltration über dieselbe Chatprotokollstrecke abläuft, entgeht sie vielen herkömmlichen Sicherheitskontrollen, Firewalls oder Datenverlustpräventionssystemen. Die Konsequenzen eines solchen Datenlecks sind gravierend.

Gerade Chatbots, die in hochsensiblen Bereichen wie Banken, Gesundheitswesen oder E-Commerce eingesetzt werden, verarbeiten häufig vertrauliche Daten. Beispielsweise können Banking-Chatbots Zahlungsdetails oder Transaktionsinformationen übermitteln, während im Gesundheitssektor Patientendaten oder Terminvereinbarungen betroffen sein können. E-Commerce-Bots transportieren oft Bestellinformationen, Session-Cookies oder Kundenadressen, die bei einer Kompromittierung weitreichenden Schaden anrichten. Ein weiterer kritischer Punkt ist die Herkunft und Verbreitung des Plugins. Die bösartige Software wurde von einem Täter unter dem npm-Alias „kuminfennel“ veröffentlicht, inklusive einer zugehörigen GitHub-Seite sowie einer verifizierbaren Kontaktadresse, die mit der Ziel-QQ-ID übereinstimmt.

Trotz der Entdeckung ist das Plugin weiterhin im npm-Registry verfügbar, was die Notwendigkeit unterstreicht, Softwarekomponenten regelmäßig auf Vertrauenswürdigkeit und Sicherheit zu überprüfen. Der Angriff illustriert ein typisches Szenario eines Supply-Chain-Angriffs, bei dem ein eigentlich legitim erscheinendes Softwarepaket kompromittiert wird, um Ziele innerhalb des Nutzerumfelds zu infiltrieren. Die Komplexität entsteht nicht nur durch den Angriff selbst, sondern durch die menschliche Komponente, die Plugins häufig ohne tiefgehende Code-Reviews oder automatisierte Sicherheitsscans installiert. Gerade im Open-Source-Ökosystem, das auf gegenseitigem Vertrauen beruht, stellen solche Vorfälle eine erhebliche Gefahr dar. Um derartige Gefahren zu begegnen, empfehlen Sicherheitsexperten verschiedene Strategien.

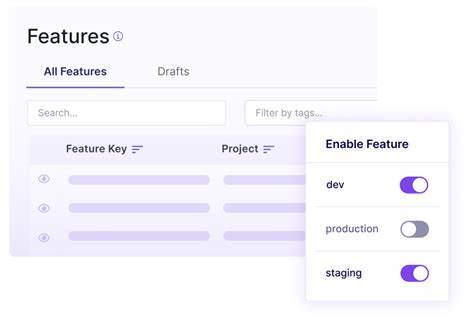

Eine sinnvolle Maßnahme ist die Isolierung von Chatbots in Containerumgebungen oder Sandboxen, die den Netzwerkverkehr strikt kontrollieren und nur authentifizierten Kommunikationskanälen erlauben, Daten zu schicken. Somit lässt sich eine unerwünschte Verbindung zu externen, nicht verifizierten Accounts blockieren. Zusätzlich setzen viele Unternehmen heute auf automatisierte Werkzeuge zur Code- und Paketüberprüfung. Tools wie der kostenlose Socket GitHub-Anwendung und Command-Line-Interface bieten dabei eine erste Verteidigungslinie, indem sie bereits beim Paketinstallationsprozess auf verdächtige Muster wie Data-Exfiltration hinweisen. Die zusätzliche Integration von Browser-Erweiterungen zur Bewertung von Risiko-Scores bei der Auswahl von Paketen reduziert das Risiko, dass Schadcode in die Codebasis Eingang findet.

Eine erhöhte Wachsamkeit ist vor allem im Kontext der steigenden Verbreitung von Chatbots entscheidend, da diese zunehmend auch in regulierten Branchen mit hohen Datenschutzanforderungen eingesetzt werden. Ein unbemerkter Datenabfluss kann nicht nur Kundenvertrauen schädigen, sondern auch zu empfindlichen Bußgeldern führen, etwa nach der DSGVO, HIPAA oder im Bereich der Zahlungsverkehrssicherheit (PCI DSS). Neben technischen und organisatorischen Maßnahmen sollten Organisationen auch die Sensibilisierung ihrer Entwickler und Betreiber fördern. Die Risiken von ungeprüften Abhängigkeiten und die Bedeutung von Code-Reviews müssen in den Entwicklungsalltag integriert werden. Ein verantwortungsvoller Umgang mit Plugins und abhängigen Bibliotheken ist heute unerlässlich, um den stetig wachsenden Bedrohungen effektiv zu begegnen.

Der Vorfall mit koishi-plugin-pinhaofa ist ein exemplarisches Beispiel für eine neue Angriffsform im Bereich der Chatbotsicherheit. Er zeigt, dass Angreifer vermehrt auf schlanke, zielgerichtete Backdoors setzen, die mit minimalem Aufwand maximale Zugriffe auf sensible Daten erzeugen. Die Herausforderung für Sicherheitsakteure besteht darin, solche Angriffsmuster frühzeitig zu erkennen und zu verhindern, bevor größere Schäden entstehen. Abschließend lässt sich festhalten, dass die Sicherheit von Chatbot-Ökosystemen eine ganzheitliche Betrachtung aller beteiligten Komponenten erfordert – von den Frameworks über die verwendeten Plugins bis hin zu den Kommunikationsprotokollen. Die konsequente Anwendung von Sicherheitsprinzipien, regelmäßige Audits und der Einsatz intelligenter Überwachungstools sind entscheidend, um die Integrität und Vertraulichkeit von Chatbot-basierten Interaktionen zu gewährleisten.

Die rasante Digitalisierung und die Nutzung von conversationalen Schnittstellen im Alltag bringen immense Vorteile mit sich, erhöhen jedoch auch die Angriffsfläche für Cyberkriminelle. Das Beispiel des koishi-plugin-pinhaofa Plugins mahnt alle Beteiligten, bei der Verwendung von Drittanbieter-Komponenten besonders vorsichtig zu sein und Sicherheitsstrategien kontinuierlich zu überprüfen und anzupassen.