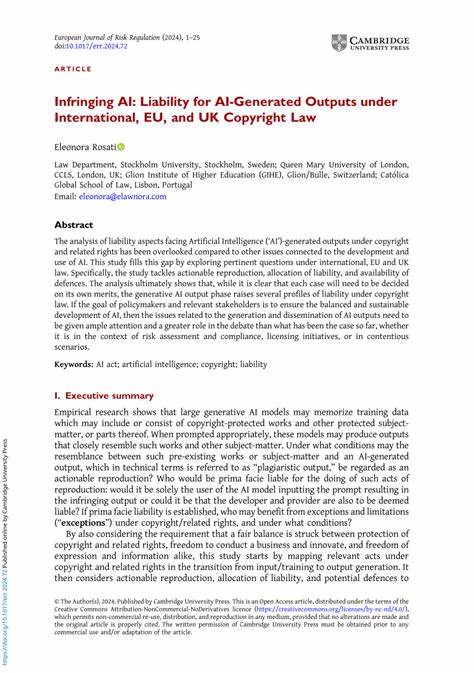

Die immer weiter fortschreitende Nutzung generativer Künstlicher Intelligenz hat nicht nur technische Innovationen vorangetrieben, sondern auch neue juristische Herausforderungen geschaffen, besonders hinsichtlich der Urheberrechtsverletzungen, die durch KI-Outputs entstehen können. Künstliche Intelligenz-Modelle, die auf der Basis großer Datensätze trainiert werden – oftmals enthalten diese geschützte Werke oder Teile davon – können unter bestimmten Umständen Inhalte erzeugen, die den Originalwerken sehr ähnlich sind oder diese sogar wortwörtlich wiedergeben. Dieses Phänomen führt zur Frage, ob und unter welchen Voraussetzungen solche Ausgaben als rechtswidrige Vervielfältigungen anzusehen sind und wer für daraus resultierende Verletzungen verantwortlich gemacht werden kann. Die internationale, europäische und britische Rechtslage zeigt, dass diese Problematik bislang noch kaum einheitlich geregelt ist und diverse Unklarheiten bestehen. Ein wichtiger Ansatzpunkt für das Verständnis der rechtlichen Fragen ist die Unterscheidung zwischen der Trainings- und der Output-Phase bei der Nutzung von KI.

Während die Trainingsphase auf die Extraktion und Verarbeitung großer Datenmengen abzielt, bei denen unter Umständen geschützte Werke verdrängt oder kopiert werden, beschränkt sich die Rechtsprechung beispielsweise in der EU und im Vereinigten Königreich auf Ausnahmen für Text- und Data-Mining (TDM) unter strikten Voraussetzungen. Diese Ausnahmen erlauben das Kopieren und Verarbeiten von Werken nur im Rahmen der Trainingsaktivitäten, nicht jedoch die direkte Reproduktion oder Veröffentlichung der geschützten Inhalte durch die KI. Somit ist die anschließende Generierung von Inhalten, die geschützte Werke imitieren, aus rechtlicher Sicht problematisch und kann eine Verletzung der Urheber- oder verwandten Schutzrechte darstellen. Auf internationaler Ebene schreibt die Berner Übereinkunft eine umfassende Schutzpflicht für Werke vor, die sich auch auf digitale Reproduktionen bezieht. Im europäischen Kontext verlangt die Richtlinie über das Urheberrecht im Informationsgesellschaft (InfoSoc-Richtlinie) eine möglichst breite Auslegung des Vervielfältigungsrechts, das nicht nur die direkte, sondern auch indirekte und temporäre Vervielfältigungen abdeckt.

Diese umfassende Auslegung bedeutet, dass viele Aktivitäten im Zusammenhang mit KI, insbesondere die Speicherung und Verarbeitung von geschützten Werken, grundsätzlich unter das Vervielfältigungsrecht fallen. Der neue EU Artificial Intelligence Act, der im Jahr 2024 verabschiedet wurde, versucht diese komplexe Situation zu regeln, indem er AI-Anbieter verpflichtet, beim Inverkehrbringen generischer Modelle in der EU alle geltenden Urheberrechtsregeln einzuhalten. Hierzu zählt insbesondere eine umfassende Dokumentations- und Transparenzpflicht bezüglich des verwendeten Trainingsmaterials. Wichtig ist, dass diese Verpflichtung für generell auf dem EU-Markt angebotene Modelle gilt, unabhängig davon, in welchem Land das Training stattfand. Für Entwickler und Anbieter von KI-Systemen bedeutet dies eine erhöhte Verantwortung, die den gesamten Lebenszyklus eines Modells, von der Auswahl der Trainingsdaten bis zu den Möglichkeiten der Ausgabesteuerung, umfasst.

Wenn KI Outputs Inhalte generiert, die geschützte Werke oder Teile davon enthalten, stellt sich die Frage nach der Haftung für diese Rechtsverletzungen. Die rechtliche Praxis zeigt, dass nicht nur die Nutzer, die in der Regel Prompts an das KI-Modell eingeben, haftbar sein können, sondern auch die Entwickler und Anbieter der KI-Systeme. Dabei kann die Haftung verschiedene Formen annehmen: primäre oder direkte Haftung bei der eigentlichen Vervielfältigung oder sekundäre bzw. mittelbare Haftung als Zubehör oder Beihilfe zur Rechtsverletzung. Die Entscheidung darüber hängt stark von den jeweiligen Umständen ab, etwa ob der Anbieter eine aktive Rolle bei der Verbreitung der rechtsverletzenden Inhalte spielt oder ob eine Umsetzung von Schutzmaßnahmen erfolgte.

Besonders interessant ist die Auslegung durch den Europäischen Gerichtshof (EuGH) und britische Gerichte zur Haftung von Online-Plattformbetreibern, da diese Rechtsprechung zunehmend auf KI-Anbieter übertragen wird. Im EuGH-Urteil YouTube (C-682/18) wurde klargestellt, dass Plattformbetreiber unter bestimmten Umständen für von Nutzern hochgeladene urheberrechtsverletzende Inhalte direkt haftbar gemacht werden können, insbesondere wenn sie nicht ausreichend auf die Verhinderung von Rechtsverletzungen achten. Eine Übertragung dieses Prinzips auf KI-Anbieter bedeutet, dass diese proaktive Maßnahmen ergreifen müssen, um die Schaffung und Verbreitung von KI-generierten, urheberrechtsverletzenden Inhalten zu verhindern – etwa durch Filter und Moderation. Auch Vertragstexte der KI-Anbieter, die versuchen, Verantwortung für Rechtsverletzungen durch Nutzer auszuschließen, sind rechtlich nicht uneingeschränkt durchsetzbar. Die Rechtsprechung betont, dass solche Haftungsbeschränkungen Dritten gegenüber, etwa den Rechteinhabern, unter Umständen unwirksam sein können.

Dadurch bleiben sowohl Nutzer als auch Anbieter in bestimmten Situationen rechtlich angreifbar. Neben der grundsätzlichen Haftungsfrage gewinnt auch der Umfang möglicher Ausnahmen und Schranken im Urheberrecht an Bedeutung. In der EU gelten strenge Anforderungen an solche Ausnahmen, die jederzeit im Einklang mit dem sogenannten Drei-Stufen-Test stehen müssen. Für Nutzer von KI-Modellen besteht potenziell die Möglichkeit, sich auf legitime Schranken wie das Zitatrecht oder Ausnahmen für Parodie und Pastiche zu berufen, sofern bestimmte Bedingungen erfüllt sind. Diese Schranken sind jedoch eng auszulegen und erfordern etwa, dass das Ausgangswerk rechtmäßig veröffentlicht wurde und die Nutzung verhältnismäßig erfolgt, ohne den Markt des Originalwerks unangemessen zu beeinträchtigen.

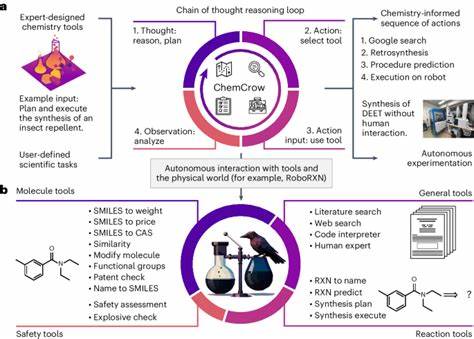

Eine weitere Herausforderung ist die Beweisführung im Urheberrechtsverletzungsverfahren im Zusammenhang mit KI. Es muss nachgewiesen werden, dass das KI-Output tatsächlich von einem geschützten Werk abgeleitet wurde und eine wesentliche Originalität aufweist, die dem Schutz unterfällt. Moderne Forschungen zeigen, dass es technisch möglich ist, den Einfluss bestimmter Ausgangsdaten im KI-Modell zu identifizieren, etwa durch Mustererkennung und Data Forensics, was im Streitfall hilfreich sein kann. Die Transparenzpflichten nach dem AI Act sollen ebenfalls zur Erleichterung der Nachweisführung beitragen. Für den Schutz von verwandten Rechten, etwa von Tonträgerherstellern oder ausübenden Künstlern, ist die Schutzschwelle niedriger, da hier nicht die Originalität, sondern die investive Leistung im Vordergrund steht.

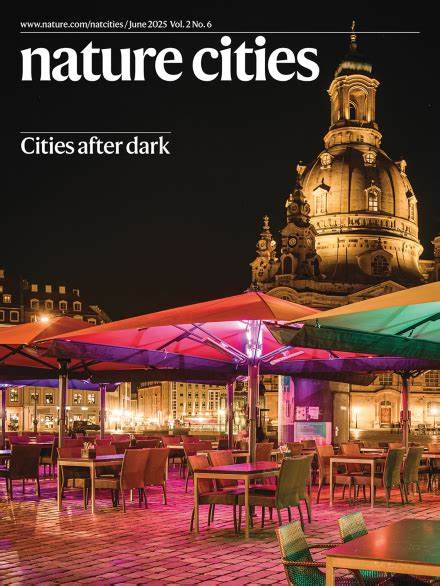

Jede nicht autorisierte Vervielfältigung entsprechender geschützter Aufnahmen kann unter diese Rechte fallen, was bei KI-generierten Nachbildungen von Stimmen, Performances oder Klangmustern relevant werden kann. Derzeit ist die Rechtslage noch volatiler als in vielen anderen Bereichen des geistigen Eigentums. Weltweit verschiedenartige Regulierungsansätze, ausgeprägter technologischer Fortschritt und die Globalität der AI-Serviceanbieter erfordern dringend abgestimmte internationale Standards und Mindestanforderungen. Initiativen wie die anstehenden Verhandlungen zu einem AI Liability Directive der Europäischen Union zielen darauf, verbesserte Haftungsregelungen für KI-bezogene Schäden, auch im Urheberrechtsbereich, zu schaffen und damit Rechtssicherheit für alle Beteiligten zu erhöhen. Abschließend ist festzuhalten, dass die nachhaltige Entwicklung von generativer KI eng mit der Etablierung klarer Haftungs- und Nutzungsregeln verbunden ist.

Es ist von wesentlicher Bedeutung, dass der rechtliche Rahmen einerseits die Rechte der Urheber und Rechteinhaber wirksam schützt und zugleich Innovation, geschäftliche Freiheit sowie die Informationsfreiheit nicht unverhältnismäßig einschränkt. Die kollektive Verantwortung von Entwicklern, Anbietern, Nutzern und Gesetzgebern wird den Weg zu einer fairen und funktionalen Lösung ebnen, die sowohl die Chancen der KI als auch die Rechte seiner Urheber berücksichtigt. In diesem Sinne verlangt der Diskurs um urheberrechtliche Haftung von KI-generierten Outputs im internationalen und europäischen Recht exakte, differenzierte und kontinuierliche Aufmerksamkeit.