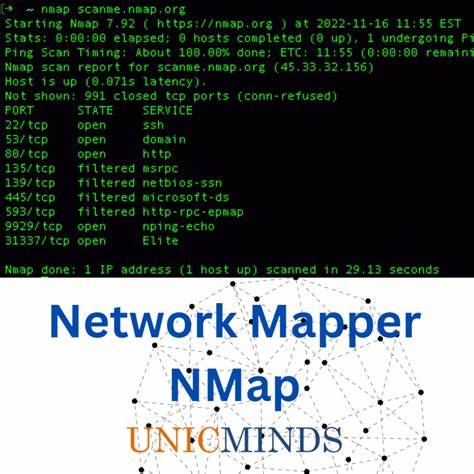

In der heutigen digitalen Welt ist die Sicherheit von Netzwerken und IT-Infrastrukturen entscheidender denn je. Tools wie Nmap haben sich seit Jahren als unverzichtbar für Security-Experten etabliert, um offene Ports zu identifizieren, Dienste zu erkennen und Schwachstellen in IT-Umgebungen zu entdecken. Parallel dazu erleben wir eine rasante Weiterentwicklung von Künstlicher Intelligenz und insbesondere von großen Sprachmodellen (Large Language Models, LLMs), die komplexe Aufgaben zunehmend automatisieren und vereinfachen. Die Kombination dieser beiden Technologien eröffnet faszinierende neue Wege im Bereich der Netzwerksicherheit. Wenn ein LLM direkten Kommandozeilenzugriff auf Nmap erhält, entstehen spannende Chancen in der Automatisierung, Analyse und Auswertung von Sicherheitsscans.

Der Gedanke, einem LLM die direkte Kontrolle über Nmap zu geben, mag zunächst ungewöhnlich erscheinen. Schließlich sind traditionelle Skripte in Bash oder Python seit Jahrzehnten bewährt, um Scanprozesse zu automatisieren und Ergebnisse zu verarbeiten. Doch die Stärke eines LLM liegt nicht nur im reinen Ausführen von Befehlen, sondern im kontext- und zielbasierten Verständnis komplexer Aufgabenstellungen. Anstatt dass ein Mensch die genauen Parameter eines Nmap-Scans vorgibt, kann das LLM aus einer natürlichen Spracheingabe verstehen, welche Art von Scan erforderlich ist. Solch ein Modell kann daraufhin automatisch die passenden Flags und NSE-Skripte auswählen und anschließend die gewonnenen Daten sinnvoll interpretieren.

Dies entlastet Fachanwender von der oft mühsamen Recherche nach passenden Befehlen und ermöglicht eine Konzentration auf die Analyse der Ergebnisse.Ein praktisches Beispiel verdeutlicht die Möglichkeiten: Ein Sicherheitsexperte könnte das LLM direkt mit einer Frage ansprechen, welche Dienste auf einem bestimmten Host laufen und ob dabei potenzielle Sicherheitsrisiken zu erkennen sind. Das LLM initiiert dann selbstständig einen umfassenden Nmap-Scan mit Optionen für Betriebssystemerkennung, Versionserkennung und Scriptscans. Die Ausgabe wird verarbeitet und in einer verständlichen Zusammenfassung präsentiert. Erwähnenswert ist dabei, dass das LLM nicht nur reine Scandaten wiedergibt, sondern auch Hinweise auf relevante Sicherheitsaspekte gibt – etwa veraltete Softwareversionen, unsichere Konfigurationen oder ungewöhnliche Dienste wie webbasierte Fernzugriffssysteme.

Solche Einschätzungen erfordern Erfahrungswissen, das fortschrittliche Modelle mittlerweile in erstaunlichem Maße simulieren können.Ein zusätzlicher Vorteil zeigt sich besonders bei der Nutzung von mehreren Tools gleichzeitig. Statt für jeden Scan manuell verschiedene Utilities oder API-Aufrufe zu steuern, kann ein LLM je nach Kontext eigenständig die passenden Instrumente auswählen, die passenden Parameter setzen und deren Ergebnisse zusammenführen. Dieses Werkzeugverständnis erlaubt nicht nur eine bessere Automatisierung, sondern fördert auch schnelle Iterationen in Aufklärungsprozessen. Sicherheitsteams könnten so schneller fundierte Entscheidungen treffen und reagieren, wenn unerwartete Schwachstellen oder Angriffsflächen entdeckt werden.

Natürlich bringt das Öffnen von Kommandozeilenbefehlen für ein KI-Modell auch erhebliche Risiken mit sich. Durch unkontrollierte oder fehlerhafte Befehle kann es zu Systemschäden oder Sicherheitsvorfällen kommen. Deshalb empfehlen Experten, solche Lösungen ausschließlich in isolierten Testumgebungen oder Laboren einzusetzen. Außerdem gilt es, die Promptgestaltung sorgfältig zu kontrollieren und sensible Produktionssysteme von automatisierten Modellen aus Sicherheitsgründen generell auszuschließen. Bis heute ersetzen LLM-gestützte Automationen zudem keine erfahrenen Analysten, sondern ergänzen deren Arbeitsprozess, indem sie wiederkehrende Aufgaben vereinfachen und den Fokus auf komplexe Auswertung legen.

Technisch wird die Integration meist durch Frameworks und Tools ermöglicht, die sogenannten „Tool-Support“ für LLMs anbieten. Beispielsweise erleichtert das Command-Line-Interface-Projekt „llm“ von Simon Willison die direkte Interaktion eines Modells mit Kommandozeilenbefehlen. Entwickler können Funktionen definieren, die Nmap aufrufen und Scans steuern, worauf das LLM zugreift. Die flexible Architektur erlaubt es, durch wenige Zeilen Code komplexe Abläufe zu orchestrieren. Lokale Modelle wie qwen3:4b, llama3.

2 oder devstral lassen sich ebenfalls einbinden und ermöglichen damit dank Open-Source-Konzepten eine breite Nutzung jenseits Cloud-Angeboten. Trotz mancher Schwierigkeiten mit der Befehlskorrektheit zeigen Tests, dass modernste Modelle wie Google Gemini Flash besonders effektiv bei der Funktionserkennung, mehrstufigen Ablaufsteuerung und Ergebnisinterpretation sind.Langfristig könnten vollständig integrierte Sicherheitsplattformen entstehen, bei denen ein LLM das Netzwerk kontinuierlich überwacht, selbstständig Nachscans durchführt und Erkenntnisse auswertet, während es mit weiteren Tools wie HTTP-Fuzzern, Metasploit oder Cobalt Strike kommuniziert. Solche Szenarien klingen futuristisch, bergen jedoch ein enormes Potenzial, um die Produktivität von Security Operations Centers (SOCs) zu steigern und Angriffsketten schneller zu durchdringen. Darüber hinaus ist denkbar, dass eine breite Nutzerschaft – auch ohne tiefgehende Nmap-Kenntnisse – Tools durch natürliche Sprache steuert und somit Sicherheitsüberprüfungen deutlich zugänglicher werden.

Die Kombination von Nmap und LLM-basierten Tool-Aufrufen ist somit mehr als eine Spielerei oder einfach nur eine neue Art der Automatisierung. Sie steht für eine bahnbrechende Verschmelzung von Expertise, KI-Fähigkeiten und etablierten Sicherheitswerkzeugen. In einer Welt, in der IT-Infrastrukturen ständig komplexer und dynamischer werden, sind solche Innovationen essenziell, um Schritt zu halten und Sicherheitslücken schnell zu erkennen. Dabei führt der Einsatz intelligenter Sprachmodelle die Netzwerksicherheit nicht einfach auf Automatisierung zurück, sondern macht sie zugänglicher, intelligenter und effizienter.Zusammenfassend lässt sich sagen, dass die Integration großer Sprachmodelle mit Nmap über Kommandozeilenschnittstellen ganz neue Möglichkeiten für Sicherheitsanalysen bietet.

Die Automatisierung gelingt nicht nur technisch, sondern auch konzeptionell durch kontextgebundene Befehlswahl und Ergebnisinterpretation. Sicherheitsprofis profitieren von der Zeitersparnis und Unterstützung bei der Auswertung komplexer Scans. Gleichzeitig bleibt der verantwortungsvolle Umgang mit KI-gesteuerten Zugriffsrechten unabdingbar, um Risiken zu minimieren. Wer sich mit dem Einsatz solcher Technologien auseinandersetzt und eigene Tools experimentell verbindet, kann in naher Zukunft von gesteigerter Effizienz, besserer Skalierbarkeit und fundierten Sicherheitsinformationen profitieren.