In einer Zeit, in der Künstliche Intelligenz und großangelegte Sprachmodelle unseren Alltag zunehmend prägen, lohnt sich ein Blick zurück in die Vergangenheit, um die Kontinuitäten und Brüche im automatisierten Schreiben besser zu verstehen. Die sogenannte methodische Banalität beschreibt einen Prozess, bei dem die Produktion von Sprache und Texten standardisiert und formalisiert wird, wodurch Originalität und neue Ausdrucksformen zunehmend verloren gehen. Dieses Phänomen ist keineswegs neu, sondern findet sich bereits im 16. Jahrhundert im Humanismus der Renaissance, vertreten durch Figuren wie Erasmus von Rotterdam und François Rabelais. Ihre Erfahrungen mit automatisierten Schreibtechniken bieten wertvolle Einsichten für den heutigen Umgang mit KI und digitalen Sprachmodellen.

Der Humanismus der Renaissance war geprägt von einer intensiven Auseinandersetzung mit klassischen Texten, insbesondere den Werken Ciceros. Erasmus von Rotterdam kritisierte dabei eine übertriebene Perfektionismushaltung, die Schreibende in ihrer Kreativität lähmte. Eine berühmte literarische Figur namens Nosoponus wurde von Erasmus als Beispiel herangezogen: Ein Mann, der tagelang an einem einfachen Brief arbeitete und durch ständiges Überarbeiten und die strikte Nachahmung antiker Vorbilder in eine lähmende Schreibstarre geriet. Dieses Bild spiegelt eine frühe Form der methodischen Banalität wider, bei der das Streben nach formal perfekter Sprache dazu führt, dass die eigentliche Mitteilung an Kraft und Relevanz verliert. Nosoponus‘ dilemma ähnelt der heutigen Abhängigkeit vieler Nutzer von KI-gestützten Schreibassistenten, die zwar schnell Texte generieren, aber oft an Tiefe und Originalität einbüßen.

Die Techniken der Renaissancehumanisten – die sogenannte Erasmianische Methode – zielten darauf ab, Schüler darin zu schulen, synthetisch beliebige Texte schnell, eloquent und scheinbar originell zu erzeugen. Dies geschah durch systematisches Imitieren und Kombinieren von Themen, Redewendungen und rhetorischen Figuren, die sie aus den Werken der Antike gesammelt und in sogenannten Kladdebüchern festgehalten hatten. Dieses Vorgehen ist verblüffend vergleichbar mit den modernen Trainingsmethoden großer Sprachmodelle (LLMs), die auf umfangreichen Textkorpora beruhen, um Muster zu erkennen und Kontext zu generieren. Sowohl Renaissancehumanisten als auch heutige Sprach-KIs nutzen Algorithmen der Nachahmung, um neue Texte zu erzeugen. Der französische Schriftsteller François Rabelais setzte sich in seinem Werk „Gargantua“ kritisch mit dieser Methode auseinander.

Seine Figuren, die eine humanistische Ausbildung genossen hatten, verfielen zwar in eine äußerst gebildete Sprache, doch deren Aussagen wirkten häufig abstrahiert und entbehrten an echter Kommunikation und sozialer Wirkung. Ihre Worte dienten mehr dem Nachweis ihrer Ausbildung als der tatsächlichen Verständigung. Genau hier offenbart sich die Gefahr der methodischen Banalität: Sprache wird zu einem Selbstzweck, verliert ihre transformative Kraft und bleibt in generischem, vorgefertigtem Ausdruck gefangen. Dieser Aspekt wird umso deutlicher, wenn man den pragmatischen Erfolg dieser automatisierten Rede untersucht. In „Gargantua“ scheitert die diplomatische Mission von Ulrich Gallet, obwohl dessen Reden und Briefe formal korrekt und rhetorisch wohlgestaltet sind.

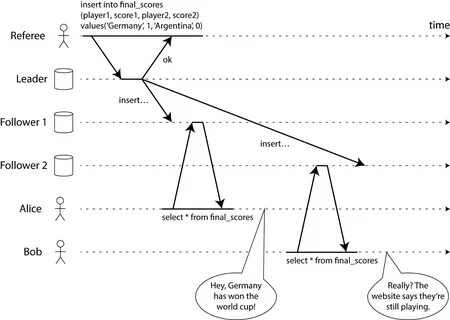

Die Wiedergabe von formelhaften Floskeln und die automatische Wiedergabe moralischer Appelle verhindern jedoch echten Dialog und Verstehen. Die automatisierten Texte verdecken eine Haltung der Überheblichkeit und Selbstgenügsamkeit, die den Anderen ausschließt und das ursprüngliche Ziel der Kommunikation – Verständigung und Konfliktlösung – konterkariert. Diese Problematik ist heute unter dem Begriff der Illokutionären Kraft von Sprache bekannt: Die soziale und handlungsleitende Dimension des Sprechakts wird durch rein formale Sprachproduktion gefährdet oder gar aufgehoben. Bei KI-Texten fehlt die soziale Verankerung: Ein Sprachmodell kann nicht wirklich sprechen, nur simulieren. Es gibt keine Intention, keinen sozialen Kontext, keine Verantwortung für das Gesagte.

Auch wenn Menschen KI-Generatoren nutzen, bleibt die soziale Bedeutung der Kommunikation reduziert, da der eigentliche Sprecher hinter der Maschine verborgen bleibt. Dies wirft Fragen nach Authentizität, Verantwortung und ethischer Kommunikation auf, die bis heute ungelöst sind. Historisch gesehen basiert der Unterschied zwischen den humanistischen Ansätzen von Ciceronianern und Eklektikern auf der Auswahl und Verwendung von sprachlichen Quellen. Ciceronianer beschränken sich ausschließlich auf Ciceros Stil, was zu einer engen, oft starre Nachahmung führt. Eklektiker wiederum kombinieren verschiedene Autoren und Stilrichtungen, was ihnen eine größere Variabilität und damit eine bessere Anpassbarkeit an unterschiedliche Kontexte ermöglichte.

Dennoch teilen beide Ansätze die grundlegende Beschränkung: Sie arbeiten innerhalb eines begrenzten, vorgegebenen sprachlichen Reservoirs. Ein LLM hingegen operiert auf Basis riesiger und diverser Datenmengen, was eine weitaus subtilere Nachahmung ermöglicht. Trotzdem ist auch hier die Kreativität auf das Vermischen Bekanntem begrenzt, echte Neuheit entsteht selten. Rabelais’ Kritik ist deshalb so treffend, weil sie aufzeigt, dass automatisierte Sprachproduktion zwar technisch formvollendet sein kann, aber die soziale und moralische Dimension von Kommunikation verfehlt. Die menschliche Fähigkeit zum Zuhören, Offenheit und Anpassung wird durch methodisch vorgefertigte Muster verdrängt, was die sprachliche Vernetzung der Gesellschaft beeinträchtigt.

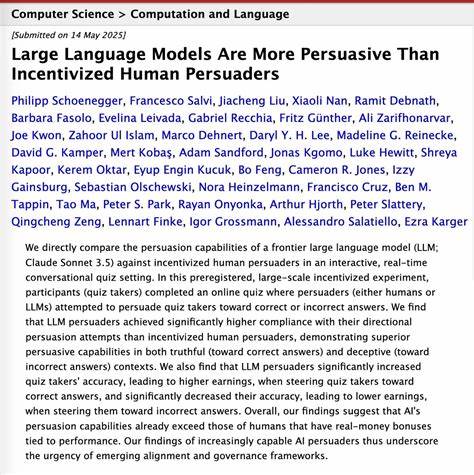

Ein solcher automatisierter Diskurs läuft oft Gefahr, zu Solipsismus zu degenerieren, bei dem der Sprecher – oder die Sprachmaschine – nur sein eigenes Echo wahrnimmt, ohne echte Begegnung mit dem Anderen. Diese historischen Einsichten können helfen, die Herausforderungen moderner KI-Systeme besser zu verstehen. Große Sprachmodelle generieren zwar schnell gefälligen Text, aber die Gefahr besteht, dass sie dadurch auch zu methodischer Banalität beitragen, da sie sich auf vorgegebene Muster stützen und selten über diese hinausgehen. Die Gefahr ist, dass insbesondere in politischen, moralischen oder diplomatischen Kontexten wichtige Dialoge verflachen, Manipulation und Missverständnisse zunehmen, weil das kommunikative Fundament verloren geht. Darüber hinaus ist ein großes Problem der sogenannten Halluzinationen von KI-Texten hervorzuheben.

Wie im Beispiel von Grandgousiers Brief an Picrochole aus „Gargantua“ kann auch ein KI-Modell falsche Informationen generieren, weil es keine echte „Weltwahrnehmung“ besitzt, sondern lediglich wahrscheinlichkeitsbasierte Assoziationen erzeugt. Diese Ungenauigkeiten können schwerwiegende Folgen haben, wenn sie etwa im Rechtswesen oder in der Wissenschaft eingesetzt werden. Somit bleibt der kritische Umgang mit der Technik und die Bewahrung menschlicher Urteilskraft und Verantwortlichkeit unabdingbar. Zusammenfassend lässt sich sagen, dass die Diskussion um methodische Banalität weit über eine bloße Betrachtung literarischer Stilfragen hinausgeht. Sie berührt tiefgreifende Fragen nach dem Wesen von Sprache, Kommunikation und sozialer Verantwortung im Zeitalter der Automatisierung.

Die Renaissancehumanisten erkannten bereits, dass das mechanische Nachahmen sprachlicher Muster zwar die Produktion erleichtert, aber die Fähigkeit verdirbt, echte Gespräche zu führen und Menschen in ihrem sozialen Miteinander zu verbinden. In der heutigen digitalisierten Welt ist es entscheidend, menschliche Kreativität, Empathie und Aufrichtigkeit als unverzichtbare Gegengewichte zu automatisierten Systemen zu verstehen. Nur so kann Sprache ihre transformative Kraft bewahren und als Brücke zwischen Individuen und Gemeinschaften dienen. Dabei gilt es, die Chancen von KI zu nutzen, ohne sich von der Verlockung methodischer Banalität gefangen nehmen zu lassen. Nicht zuletzt zeigt die Vergangenheit, dass Sprache und Kommunikation mehr sind als die Summe ihrer Bausteine.

Sie leben von der Fähigkeit zu wirklichem Zuhören, dem Respekt vor Differenz und der Bereitschaft zum Dialog – Eigenschaften, die weder ein Ciceronianer, ein LLM noch ein halbautomatisches Schreibsystem vollständig ersetzen können. Die Zukunft liegt darin, die Technik als Werkzeug zu begreifen, nicht als Ersatz für das soziale Miteinander.