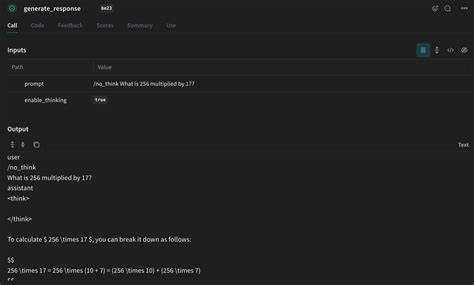

Qwen3 markiert einen bedeutenden Fortschritt im Bereich der Large Language Models (LLMs), indem es fortschrittliche Fähigkeiten wie verbesserte Schlussfolgerungen, herausragende Befolgung von Anweisungen, Agentenfunktionen und nahtlose mehrsprachige Unterstützung bietet. Die jüngste Einführung der Feinabstimmung auf der Unsloth-Plattform eröffnet Anwendern zudem neue Möglichkeiten, diese leistungsstarken Modelle sowohl effizient als auch ressourcenschonend einzusetzen. Die Kombination von Qwen3 und Unsloth ist damit ein Meilenstein auf dem Weg zu noch besseren Ergebnissen im Bereich künstlicher Intelligenz. Die Weiterentwicklung von Qwen3 zeigt sich nicht nur in der Architektur und den Fähigkeiten der Modelle, sondern auch in innovativen Techniken für den Betrieb und die Feinjustierung. Besonders hervorzuheben ist die Verwendung der Unsloth Dynamic 2.

0 Methodik, die speziell darauf ausgelegt ist, quantisierte Qwen3 Modelle mit minimalem Genauigkeitsverlust auszuführen und zu optimieren. Durch diese Methodik können 5-Shot MMLU- und KL-Divergenz-Benchmarktests auf höchstem Niveau durchgeführt werden, was die praktische Tauglichkeit und die Qualität der Modelle eindrucksvoll unterstreicht. Unsloth Dynamic 2.0 ist ein entscheidender Schritt, um die Leistungsfähigkeit der Modelle zu maximieren und gleichzeitig den Ressourcenverbrauch signifikant zu reduzieren. Anwender profitieren bei der Feinabstimmung beispielsweise von einer zweifachen Beschleunigung gegenüber herkömmlichen Methoden und einer Reduktion des benötigten Grafikspeichers um rund 70 Prozent.

Damit wird es möglich, selbst die großen und komplexen Qwen3-Modelle auf begrenzterer Hardware komfortabel zu betreiben und zu trainieren, was bisher nur sehr eingeschränkt möglich war. Ein weiterer Meilenstein ist die native Unterstützung einer Kontextlänge von bis zu 128.000 Tokens. Qwen3 nutzt hierfür die so genannte YaRN-Technologie, um die ursprüngliche Begrenzung von 40.000 Tokens erheblich zu erweitern.

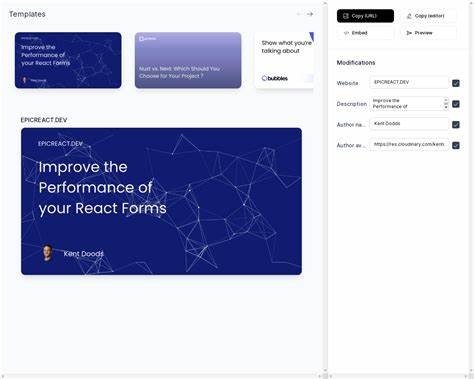

Diese Erweiterung ermöglicht nicht nur das Arbeiten mit besonders langen Texten, sondern öffnet auch ganz neue Anwendungsfelder im Bereich Dokumentanalyse, komplexer Dialogsysteme und Medienproduktionen mit einem deutlich erweiterten Kontextverständnis. Auf der Unsloth-Plattform sind mittlerweile eine Vielzahl von Qwen3-Varianten verfügbar, angefangen beim kompakten 8-Milliarden-Parameter-Modell bis hin zu den gigantischen 30- und 235-Milliarden-Parameter-MOE-Modellen. Besonders erwähnenswert ist die Möglichkeit, mit dynamischen 4-Bit-Quantisierungen und GGUF-Formatversionen zu arbeiten, die sowohl die Effizienz verbessern als auch die Kompatibilität mit verschiedenen Frameworks gewährleisten. Diese breite Unterstützung macht Unsloth äußerst flexibel und universell einsetzbar für unterschiedlichste KI-Aufgaben. Die Feinabstimmung der Qwen3-Modelle wird durch dedizierte Notebooks stark vereinfacht, die unter anderem auf Google Colab bereitgestellt werden.

Die vorhandenen Tutorials und Guides führen Nutzer Schritt für Schritt durch den Prozess von der Vorbereitung der Daten bis zur Durchführung des Trainings und der anschließenden Evaluierung. Insbesondere bei der Arbeit mit Datensätzen wie Alpaca profitiert man von den optimierten Pipelines, die auf die Besonderheiten der Qwen3-Modelle zugeschnitten sind. Ein weiterer Vorteil liegt im Einsatz von Flash Attention 2, das in der Unsloth-Umgebung zur Verfügung steht und besonders bei großen Modellen nicht nur die Trainingsgeschwindigkeit erhöht, sondern auch den VRAM-Bedarf weiter senkt. Flash Attention 2 ermöglicht längere Kontextfenster, die bei der Modellarchitektur berücksichtigt werden können, was das Training deutlich stabiler und reaktiver macht. Darüber hinaus unterstützt Unsloth eine komplette Bandbreite an Trainingsalgorithmen und -techniken.

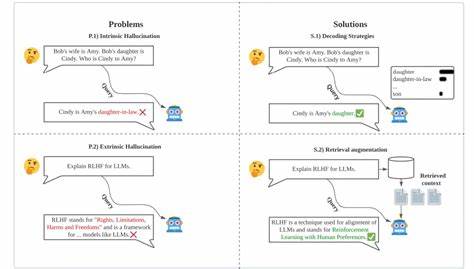

Egal, ob es sich um klassische Feinabstimmungsmethoden, fortschrittliche Pretraining-Ansätze oder spezialisierte Verfahren wie GRPO handelt, die Unsloth-Plattform stellt die nötigen Werkzeuge bereit. Dies gilt nicht nur für einfache Transformer-Modelle, sondern auch für komplexe Architecturen wie MOE oder Phi-4. Die Integration von visuellen Sprachmodellen (VLMs) erweitert die Anwendungsbereiche von Qwen3 und macht die Plattform zukunftssicher. Die Nutzerfreundlichkeit von Unsloth wird außerdem durch eine engagierte Community ergänzt, die über Reddit, Discord und weitere soziale Medien erreichbar ist. Gerade bei komplexen KI-Projekten ist der Austausch mit anderen Anwendern und Entwicklern von unschätzbarem Wert.

Die Betreiber von Unsloth stellen zudem aktuelle Updates und Performanceberichte bereit, sodass Interessierte stets auf dem letzten Stand der Entwicklung bleiben können. Zusammenfassend lässt sich sagen, dass Qwen3 in Verbindung mit der Unsloth-Plattform eine leistungsstarke Kombination für moderne KI-Anwendungen darstellt. Die Fähigkeit, verschiedenste Modelle mühelos zu betreiben und zu verbessern, kombiniert mit der Möglichkeit zur Arbeit mit extrem langen Kontexten und der Unterstützung von vielfältigen Trainingsalgorithmen, setzt neue Maßstäbe. Wer die Grenzen seines KI-Projekts erweitern möchte, findet in Qwen3 und Unsloth leistungsstarke Werkzeuge, die durch Effizienz, Geschwindigkeit und Flexibilität überzeugen. Für Einsteiger und Experten gleichermaßen bietet Unsloth eine ideale Umgebung, die den Zugang zu hochentwickelten KI-Modellen erleichtert und dabei auf langfristige Skalierbarkeit setzt.

Die ständige Weiterentwicklung und der offene Austausch mit der Community schaffen zudem die Voraussetzungen für nachhaltige Innovationen im wachsenden Bereich der künstlichen Intelligenz. Wer also mit Qwen3 Erfolg haben möchte, sollte dringend einen Blick auf Unsloth werfen, um das volle Potential der Modelle auszuschöpfen – und das ganz ohne kostspielige Hardware-Upgrades. Mit der passenden Software und der richtigen Strategie ist die Zukunft der KI-Entwicklung nicht nur leistungsfähiger, sondern auch zugänglicher als je zuvor.