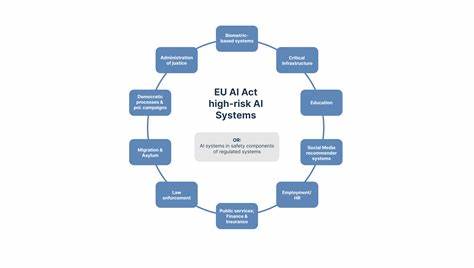

Die Europäische Union steht an der Schwelle zu einer neuen Ära im Umgang mit Künstlicher Intelligenz (KI). Mit der geplanten KI-Verordnung, die auch als AI Act bekannt ist, möchte sie einen Rahmen schaffen, der den Einsatz von KI-Systemen sicher, transparent und ethisch vertretbar gestaltet. Im Zentrum dieser Regulierung steht die Klassifizierung von Hochrisikosystemen, die aufgrund ihres potenziellen Einflusses auf Sicherheit, Grundrechte und gesellschaftliche Abläufe besonders sorgfältig überwacht werden müssen. Um den Entwurf des AI Act weiter zu entwickeln, hat die EU eine öffentliche Konsultation gestartet, in der Bürgerinnen und Bürger, Unternehmen, Expertinnen und Experten sowie andere Interessengruppen ihre Sichtweisen einbringen können. Diese Beteiligung ist ein wesentlicher Bestandteil des legislativen Prozesses und soll sicherstellen, dass die Verordnung nicht nur rechtlich fundiert, sondern auch praktisch umsetzbar und ausgewogen ist.

Die KI-Technologie hat in den letzten Jahren enorme Fortschritte gemacht und ist mittlerweile in vielen Bereichen des täglichen Lebens und der Wirtschaft präsent. Dabei reichen die Anwendungen von einfachen Chatbots über automatisierte Fahrzeugsteuerung bis hin zu medizinischer Diagnose oder vernetzten Überwachungssystemen. Doch gerade bei sensiblen Anwendungsfeldern können Fehlfunktionen oder Missbrauch gravierende Folgen haben. Hochrisikosysteme zeichnen sich durch ihren potenziellen Einfluss auf die Sicherheit von Menschen, den Schutz der Privatsphäre, das Recht auf Nichtdiskriminierung und weitere Grundrechte aus. Die EU-Kommission möchte durch den AI Act klare Vorgaben machen, wie diese Systeme entwickelt, getestet und eingesetzt werden dürfen.

Die öffentliche Konsultation fokussiert sich darauf, wie Hochrisikosysteme definiert und klassifiziert werden sollten. Dabei werden verschiedene Kriterien wie der Anwendungsbereich, die potenzielle Gefährdung oder das Ausmaß der Betroffenheit von Personen untersucht. Ziel ist es, eine klare und praktikable Liste von Hochrisikosystemen zu erstellen, die es den Aufsichtsbehörden ermöglicht, effizient zu kontrollieren und gegebenenfalls einzugreifen. Gleichzeitig möchte die EU die Innovationskraft der KI-Branche erhalten und nicht durch übermäßige Regulierung bremsen. Die Balance zwischen Schutz und Förderung ist besonders herausfordernd, da KI rasch weiterentwickelt wird und neue Einsatzszenarien entstehen.

Ein weiterer wichtiger Aspekt der Konsultation ist die Frage, wie Transparenz und Verantwortung in Bezug auf Hochrisikosysteme sichergestellt werden können. Dies betrifft etwa die Dokumentationspflichten der Anbieter, die Erklärbarkeit der Entscheidungen von KI-Systemen und die Informationspflicht gegenüber Nutzerinnen und Nutzern. Durch klare Standards soll verhindert werden, dass Nutzerinnen keine Ahnung haben, wie ein Algorithmus zu einem bestimmten Ergebnis kommt, insbesondere wenn dieses erhebliche Auswirkungen haben kann. Die Diskussion dreht sich zudem um die Rolle von Zertifizierungen und Prüfverfahren, mit denen Hochrisikosysteme vor dem Inverkehrbringen auf Sicherheit und Regelkonformität überprüft werden. Hier sind technische Normen, Auditmechanismen und unabhängige Prüfstellen von Bedeutung.

Die EU strebt an, einen europäischen Standard zu schaffen, der weltweit als Vorbild dienen könnte. Die öffentliche Konsultation ist offen für vielfältige Perspektiven. Unternehmen aus verschiedenen Branchen können darlegen, welche Anforderungen sie an die Regulierung haben, zum Beispiel im Hinblick auf den Entwicklungsaufwand, die Kosten für Compliance und die Auswirkung auf die Wettbewerbsfähigkeit. Gleichzeitig können zivilgesellschaftliche Organisationen und Verbraucherschützer auf Risiken hinweisen und Forderungen nach strengeren Schutzmaßnahmen einbringen. Auch Akademikerinnen und Akademiker, die sich mit Ethik, Recht und Technik beschäftigen, tragen mit Empfehlungen zur inhaltlichen Ausgestaltung bei.

Die Transparenz der Konsultation und die Möglichkeit zur Beteiligung zeigen, dass die EU großen Wert auf einen demokratischen und fundierten Prozess legt. Die Ergebnisse der Befragung werden in die weitere Ausarbeitung der KI-Verordnung einfließen. Sie können dazu beitragen, das Vertrauen der Bevölkerung in KI-Technologie zu stärken. Gerade in Zeiten, in denen KI zunehmend in sensiblen Bereichen eingesetzt wird, sind klare Spielregeln essentiell, um Missbrauch zu verhindern und negative gesellschaftliche Folgen abzufedern. Die Herausforderungen liegen nicht nur in der technischen Umsetzung, sondern auch in der internationalen Abstimmung, da KI kein rein europäisches Thema ist.

Dennoch will die EU mit ihrer Regulierung Vorreiter sein und Standards setzen, die auch global Akzeptanz finden können. Parallel zur Konsultation laufen in unterschiedlichen EU-Institutionen Debatten, wie das Rechtswerk möglichst wirksam gestaltet werden kann. Dabei müssen auch Fragen der Sanktionen, der Aufsicht und der Zusammenarbeit zwischen den Mitgliedstaaten geklärt werden. Der AI Act steht exemplarisch für die Bemühungen, technologische Innovation mit ethischen und rechtlichen Prinzipien zu vereinen und damit die Zukunft von KI verantwortungsvoll zu gestalten. Insgesamt ist die öffentliche Konsultation zur Einstufung von Hochrisikosystemen ein wichtiger Schritt im legislativen Prozess.

Sie reflektiert die komplexe Balance zwischen Nutzungspotenzialen und Risiken von KI und lädt alle Interessierten ein, sich aktiv an der Gestaltung eines Rahmens zu beteiligen, der Sicherheit, Transparenz und Innovation vereint. Für die kommenden Jahre wird der AI Act ein entscheidendes Dokument sein, das den Umgang mit Künstlicher Intelligenz in Europa grundlegend prägt und Maßstäbe setzt, wie technologische Entwicklung im Dienste der Gesellschaft gestaltet werden kann.