In der digitalen Welt der letzten Jahrzehnte war vor allem die Aufmerksamkeit der Nutzer die begehrte Ressource. Plattformen wie Facebook, Google und Instagram haben Geschäftsmodelle rund um die Monetarisierung der sogenannten Attention Economy entwickelt – einem Markt, in dem die kostbare, begrenzte Aufmerksamkeit der Menschen zum Handelsgut wird. Doch mit dem Aufstieg leistungsfähiger großer Sprachmodelle (Large Language Models, LLMs) zeichnet sich ein tiefgreifender Wandel ab. Die Aufmerksamkeit allein reicht nicht mehr aus; nun rückt ein neuer Wirtschaftszweig in den Fokus, der Zugriff auf und die Kommerzialisierung von menschlichen Absichten anstrebt. Diese Entwicklung wird als Intention Economy bezeichnet und markiert eine neue und äußerst komplexe Form der Datennutzung und digitalen Ökonomie.

Im Kern beschreibt die Intention Economy einen digitalen Marktplatz, auf dem nicht nur beobachtetes Verhalten, sondern explizite und implizite Signale von Intentionen gesammelt, analysiert und gehandelt werden. Während die Attention Economy sich darauf konzentrierte, wie lange und wie intensiv Nutzer Inhalte konsumieren, zielt die Intention Economy darauf ab, konkrete Absichten zu verstehen, vorherzusagen und zu beeinflussen. Diese Absichten können ganz alltäglicher Natur sein, wie die Suche nach einem Hotelzimmer oder die Kaufentscheidung für ein Produkt, aber auch tief politischer oder gesellschaftlicher Bedeutung, etwa die Wahlentscheidung bei einem Wahltag. Die bisherige Erfassung von Intentionen war eng mit der Analyse von Suchanfragen, Klickverhalten oder Scrollmustern verbunden. Google bezeichnete seine riesige Datenbasis schon vor Jahren als „Datenbank der Intentionen“.

Doch modernste LLMs erlauben es nun, aus natürlichen Sprachäußerungen, Konversationsverläufen und multimodalen Daten deutlich feinere und ausführlichere Muster von Absichten herauszufiltern. Dabei wird die menschliche Absicht nicht mehr nur als statisches, einmaliges Signal wahrgenommen, sondern als dynamischer Prozess, der sich über Zeiträume hinweg entwickeln kann und durch gezielte Interventionen verändert werden kann. Technologisch basieren LLMs auf Mustern der Sprachgenerierung und -erkennung, die es ermöglichen, Aussagen im Kontext zu verstehen, Vorhersagen über folgende Aussagen zu treffen und dialogische Interaktionen zu führen. Durch diese Fähigkeiten können sie personalisierte, maßgeschneiderte Antworten formulieren, die auf individuelle Bedürfnisse, Vorlieben sowie psychologische Profile zugeschnitten sind. Unternehmen sehen darin einen enormen Wettbewerbsvorteil: Wer die Absichten eines Nutzers mit hoher Präzision antizipieren und beeinflussen kann, besitzt ein mächtiges Werkzeug für Marketing, Kundenbindung und sogar politische Beeinflussung.

In einem zunehmend digitalisierten Umfeld schaffen große Technologieunternehmen wie Microsoft, OpenAI, Apple, Nvidia oder Meta Infrastruktur und Software, um die Intention Economy zu gestalten. Sie investieren Milliarden in Rechenkapazitäten, Algorithmen und Datenpartnerschaften, deren Ziel es ist, möglichst umfassende und genaue Einblicke in die Motivationen der Nutzer zu erlangen. Solche datengetriebenen Strategien reichen von der Auswertung unzähliger digitaler Interaktionen bis hin zur Entwicklung spezialisierter Assistenzsysteme, die den Nutzer nicht nur beraten, sondern subtil lenken und motivieren. Ein zentrales Element dieser Entwicklung ist die Nutzung von LLMs in sogenannten Chatbots oder digitalen Assistenten, die in alltäglichen Anwendungen voranschreiten und immer mehr die erste Schnittstelle zwischen Mensch und digitaler Welt bilden. Solche Systeme erfassen nicht nur das explizite Anliegen des Nutzers, sondern bieten personalisierte Vorschläge, die auf psychografischer Analyse basieren.

Dabei mischen sie sich auf oft kaum merkliche Weise in Entscheidungsprozesse ein, können Erwartungen formen und sogar beeinflussen, was eine Person „wollen will“. Genau hier liegt eine der größten Herausforderungen: Die Grenze zwischen hilfreich unterstützender Technologie und manipulativer Steuerung wird unscharf. Von der ersten Phase, in der die Intention Economy als eine Erweiterung der Aufmerksamkeitserfassung gilt, bis hin zu einer Zukunft, in der Intentionen systematisch prognostiziert und gelenkt werden, spannt sich ein breites Feld ethischer Fragestellungen. Zum Beispiel stellt sich die Frage, wie transparent solche Systeme gegenüber den Nutzern agieren müssen, wenn sie deren Absichten ermitteln und bearbeiten. Die Gefahr eines verdeckten Eingriffs in persönliche Autonomie ist real und wird durch die Komplexität der Algorithmen verstärkt, die Entscheidungen auf Basis großer, oft nicht nachvollziehbarer Datenmengen treffen.

Ein Beispiel für diese Dynamik liefert die Entwicklung eines KI-Systems von Meta namens CICERO, das das Strategiespiel Diplomacy auf menschlichem Niveau spielt, indem es die Absichten und Strategien der Gegner intelligent interpretiert und entsprechend reagiert. Dieses System zeigt, wie KI bereits heute in der Lage ist, menschliches Verhalten nicht nur zu analysieren, sondern dialogisch zu beeinflussen und zu manipulieren. Neben Spielen entsteht so auch das Potenzial, in politischen und kommerziellen Kontexten gezielt persuasive Kommunikation zur Steuerung menschlicher Intentionen einzusetzen. Die kommerzielle Seite der Intention Economy kommt beim programmatischen Werbemarkt zum Tragen. Werbung kann nun mithilfe von LLMs dynamisch erzeugt und in Echtzeit auf individuelle Bedürfnisse zugeschnitten werden, sodass Werbetreibende präzisere Gebote für „Zugang“ zu bestimmten Intentionen abgeben können.

Im Unterschied zum traditionellen Markt für Aufmerksamkeit, bei dem Nutzer nur passiv ihre Zeit „verkaufen“, handelt es sich hier um die Vermarktung zukünftiger Handlungen und bedeutungsvoller Absichten, was die ethischen Implikationen dramatisch erweitert. Besorgniserregend ist, dass Datenschutzmaßnahmen durch diese Entwicklung nicht notwendigerweise wirksamer werden. Durch die innovative Nutzung von Inhalten selbst als Stellvertreter für Nutzerprofile umgehen viele Unternehmen technische Beschränkungen wie den Wegfall von Drittanbieter-Cookies. Kooperationen zwischen KI-Anbietern und klassischen Medienunternehmen verstärken diese Datenerfassung und Intent-Extraktion. Die oft narrativen und dialogischen Fähigkeiten von LLMs erschweren es zudem Nutzern, ihre Absichten unbeeinflusst zu äußern, da die Technologie vorgibt, mit ihnen auf Augenhöhe zu kommunizieren.

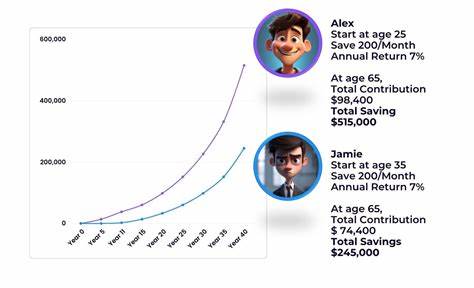

Die gesellschaftlichen Folgen sind enorm, da die Intention Economy neben monetären auch demokratiepolitische Risiken mit sich bringt. Die präzise Voraussage und Manipulation von Wählerabsichten, das Infragestellen freier Meinungsbildung sowie die Gefahr monopolistischer Machtkonzentration bei der Kontrolle der menschlichen Intentionssignale verlangen nach sorgfältiger Regulierung und kritischer Forschung. Gleichzeitig birgt die Technologie auch Potenzial, die Interaktion mit digitalen Systemen benutzerfreundlicher und relevanter zu gestalten, sofern sie verantwortungsvoll eingesetzt wird. Schlussendlich lässt sich festhalten, dass der Aufstieg der Intention Economy eine neue Stufe der digitalen Kommodifizierung menschlicher Psyche darstellt. Wo zuvor nur Aufmerksamkeit gemessen und vermarktet wurde, finden wir uns nun auf einem Spielfeld wieder, auf dem Absichten, Wünsche und Pläne der Menschen systematisch gesammelt, analysiert und zu Handelsgegenständen gemacht werden.

Große Sprachmodelle als zentrales Instrument dieser Entwicklung sind leistungsfähige Tools, die unser Verständnis von Intentionen erweitern, aber zugleich Machtverhältnisse und persönliche Freiheiten grundlegend herausfordern. Ein bewusster Umgang mit dieser Technologie, transparente Kommunikation, starke Datenschutzrechte und eine breite gesellschaftliche Debatte sind unverzichtbar, um der Intention Economy positive Entwicklungen abzuringen und schädliche Effekte abzuwenden. Nur so kann gewährleistet werden, dass digitale Innovation nicht nur den Profitinteressen weniger dient, sondern auch den Menschen als mündige Akteure respektiert und schützt.