Die zunehmende Verbreitung und Bedeutung künstlicher Intelligenz (KI) hat zahlreiche gesellschaftliche, wirtschaftliche und rechtliche Fragen aufgeworfen. Insbesondere im Bereich des Urheberrechts gibt es seit einiger Zeit erhebliche Unsicherheiten und Diskussionen, wie KI-generierte Inhalte zu behandeln sind und wie die bestehenden Gesetze an diese neue Realität angepasst werden müssen. Eine kontroverse Debatte dreht sich um die Frage, ob Regierungen bewusst KI-Urheberrechtsverletzungen ignorieren, um damit möglicherweise belastendes Material über Personen zu sammeln und damit wirtschaftlichen oder politischen Druck auszuüben. Diese These klingt wie aus einem Spionageroman, doch angesichts der Komplexität und Intransparenz moderner Rechtsdurchsetzung ist es wichtig, die Fakten, Hintergründe und Implikationen objektiv zu betrachten. Zunächst gilt es zu verstehen, welche Rolle das Urheberrecht bei KI-generierten Inhalten überhaupt spielt.

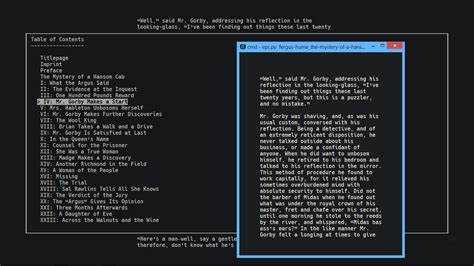

Traditionell schützt das Urheberrecht kreative Werke, die als Resultat menschlicher Schöpfung gelten. KI-Modelle erzeugen jedoch Inhalte auf Basis riesiger Datensätze, die teilweise urheberrechtlich geschützte Werke enthalten. Ob und wie eine KI-erschaffene Grafik, ein Text oder ein Musikstück als eigenständiges Werk mit Urheberrecht zu betrachten ist, ist rechtlich verbreitet noch ungeklärt. In vielen Ländern existieren bislang keine klaren Regelungen, die diese Situation explizit abdecken. Wenn KI-Modelle urheberrechtlich geschützte Inhalte ohne Erlaubnis verwenden, entsteht also ein Spannungsfeld zwischen Innovation, künstlerischer Freiheit und geltendem Recht.

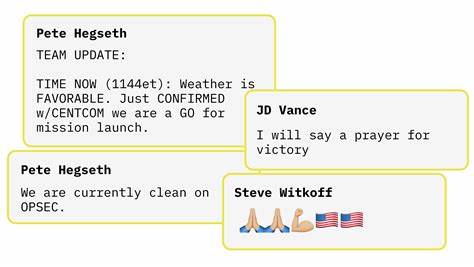

Einige Unternehmen oder Einzelpersonen, deren Werke durch KI reproduziert oder verändert wurden, versuchen gegen die unautorisierte Nutzung vorzugehen. Doch die Durchsetzung solcher Rechte gestaltet sich schwierig, insbesondere weil KI-Inhalte verbreitet und oft anonym im Netz auftauchen. Vor diesem Hintergrund erheben Kritiker die Vermutung, staatliche Behörden oder Regierungen könnten durch Zurückhaltung bei der Ahndung von KI-Urheberrechtsverstößen ein Opportunitätsfenster schaffen, um Personen, die beispielsweise durch die Nutzung von KI-Inhalten in der Kritik stehen, gezielt unter Druck zu setzen. Die Idee dahinter ist, dass die staatlichen Stellen bewusst nicht einschreiten und Beweismittel, sprich die digital hinterlassenen Spuren und Inhalte, speichern, um in Situationen strategisch reagieren zu können. Diese Hypothese beruht auf dem Konzept der Überwachung und des Informationsmonopols, das insbesondere von autoritären Regierungen häufig genutzt wird.

In demokratischen Gesellschaften gilt das allerdings als problematisch, weil es Grundrechte wie die Privatsphäre und die Rechtssicherheit unterminiert. Den Regierungen stehen Rechtsschutzinstitutionen und Transparenzpflichten gegenüber, sodass ein systematisches Ignorieren von Urheberrechtsverstößen zum Zwecke der Erpressung erhebliche rechtliche und ethische Hürden mit sich bringt. In den USA beispielsweise sind US-Regierungswerke generell urheberrechtsfrei, da sie im öffentlichen Bereich angesiedelt sind. Trotzdem gibt es ohnehin wenig Ansätze, dass die US-Bundesbehörden systematisch aktiv Fälle von KI-Urheberrechtsverletzungen verfolgen oder ignorieren, um damit Daten für politische Zwecke zu sammeln. Das föderale und vielfältige Rechtssystem in den USA erschwert zudem eine zentrale Steuerung solcher Aktionen.

Anders sieht es in Ländern mit weniger starken demokratischen Institutionen aus, wo solche Überlegungen eher greifbar sein könnten. Dort herrscht oftmals eine stärkere Kontrolle von Medien und Informationsflüssen durch die Regierung, was die Möglichkeit eröffnet, KI als Werkzeug sowohl zur Überwachung als auch zur Einflussnahme einzusetzen. Wichtig ist außerdem, die technische Komplexität zu berücksichtigen. KI-Systeme arbeiten oft opak und schwer durchschaubar. Es ist schwierig, klar nachzuweisen, welche Daten und Werke tatsächlich zur Generierung eines bestimmten KI-Inhalts beigetragen haben.

Aufgrund dieser fehlenden Transparenz sind juristische Verfahren gegen vermeintliche Urheberrechtsverletzungen bei KI-Inhalten noch sehr selten und problematisch. Die staatlichen Institutionen stehen folglich nicht nur vor einer Herausforderung der Rechtsdurchsetzung, sondern auch vor technischen und ethischen Fragen. Aktuelle Gesetzesreformen und Regulierungsdebatten weltweit versuchen, auf diese Herausforderungen zu reagieren. Sowohl auf europäischer Ebene als auch in verschiedenen Ländern wird diskutiert, wie KI-Modelle reguliert und wie der Schutz geistigen Eigentums gewahrt werden kann, ohne die Innovationskraft der Technologie zu stark einzuschränken. Für Unternehmen und Kreative stellt sich die Frage, wie sie sich schützen und ihre Rechte durchsetzen können.

Gleichzeitig müssen sie sich bewusst sein, dass eine zu strenge oder undurchsichtige Rechtslage riskieren kann, die freie Nutzung von Technologie und die kreative Weiterverarbeitung zu behindern. Schließlich hat die Frage, ob Regierungen Urheberrechtsverletzungen bewusst ignorieren, um Menschen zu kontrollieren oder zu erpressen, einen starken spekulativen Charakter. Belege für eine systematische Praxis liegen bisher nicht vor. Die politische und rechtliche Realität in demokratischen Staaten ist meist durch Prüfsysteme und öffentliche Kontrolle geprägt. Gleichwohl wirft der Diskurs wichtige Fragen nach Transparenz, Verantwortlichkeit und den Grenzen staatlicher Macht auf, die in einer digitalisierten Welt zunehmend relevant sind.

Zusammenfassend lässt sich sagen, dass weder technische noch rechtliche Rahmenbedingungen aktuell ausreichend sind, um KI-Urheberrechtsverletzungen klar, einheitlich und konsequent zu behandeln. Die Vorstellung, dass Regierungen diesen Umstand ausnutzen könnten, hat zwar eine gewisse theoretische Plausibilität in autoritären Kontexten, ist aber in demokratischen Systemen mit solider Rechtsstaatlichkeit kaum belegbar. Die Debatte regt jedoch unbedingt dazu an, die Rechtslage zu schärfen, größere Transparenz zu schaffen und verantwortungsvolle Nutzung von KI-Technologien auf allen Ebenen zu fördern.