In der heutigen Zeit sind Large Language Models (LLMs) zu einem unverzichtbaren Werkzeug in vielen Bereichen der Künstlichen Intelligenz geworden. Von automatisierter Textgenerierung über maschinelle Übersetzungen bis hin zu komplexen Analyseanwendungen setzen Unternehmen und Forschungsinstitutionen auf diese leistungsstarken Modelle, um anspruchsvolle Aufgaben zu bewältigen. Doch trotz der beeindruckenden Fähigkeiten der LLMs steht die Community oft vor großen Herausforderungen bei der Auswahl und Anpassung der besten Modelle unter Berücksichtigung begrenzter Ressourcen und Kosten. Der Prozess, das am besten geeignete LLM und die passende Anpassungsstrategie zu finden, ist häufig experimentell, zeitaufwändig und ressourcenintensiv. Es erfordert zahlreiche Probeläufe und vergleiche, um festzustellen, wie sich ein Modell in einer konkreten Anwendung verhält und welches Anpassungsverfahren den besten Kompromiss zwischen Leistung und Kosten darstellt.

Hier setzt COSMOS an – ein innovatives Framework, das eine zuverlässige, vorhersagbare und kosteneffiziente Anpassung von LLMs ermöglicht. COSMOS steht für ein vereinheitlichtes Prognosemodell, das die Ergebnisse von unterschiedlichen Anpassungsstrategien nicht nur genau vorhersagen kann, sondern dies auch bei minimalem Aufwand schafft. Innovativ ist dabei der Ansatz, nicht erst durch teure Tests die Leistungsfähigkeit eines feinjustierten Modells zu ermitteln, sondern diese bereits über leichte und kostengünstige Proxy-Modelle sowie skalierbare Vorhersagegesetzmäßigkeiten abzuschätzen. Dadurch werden erhebliche Ressourcen eingespart, was einen schnelleren und vielfältigeren Einsatz der Modelle erlaubt. Zentraler Bestandteil von COSMOS sind zwei leistungsstarke Vorhersagemodelle.

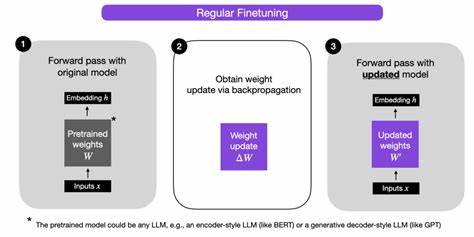

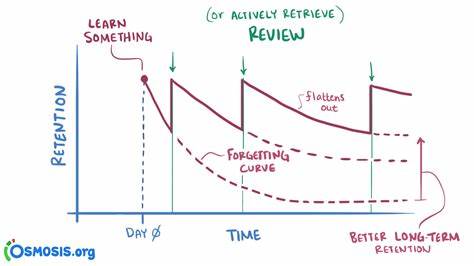

Zum einen gibt es embedding-unterstützte, leichte Proxy-Modelle, die speziell entwickelt wurden, um die Leistung bei der Feinabstimmung (Fine-Tuning) von LLMs abzuschätzen. Statt den gesamten Trainingsprozess durchzuführen, greifen diese Modelle auf repräsentative Repräsentationen zurück und bieten eine verlässliche Schätzung der erwarteten Modellqualität. Zum anderen nutzt COSMOS sogenannte Low-Sample-Scaling-Laws, also Vorhersagegesetze, die mit wenigen Datenpunkten die Leistungsentwicklung von Retrieval-augmented In-Context Learning erfassen können. Dies ist besonders relevant, wenn man mit wenigen Beispielen neue Aufgabenstellungen schnell adaptieren möchte. Durch diese Kombination schafft COSMOS die Möglichkeit, Anpassungsstrategien unterschiedlicher Art effektiv zu bewerten und zu optimieren.

Das Framework wurde anhand von acht repräsentativen Benchmarks umfassend evaluiert. Dabei konnte COSMOS nicht nur eine hohe Vorhersagegenauigkeit erzielen, sondern auch den Rechenaufwand im Durchschnitt um über 90 Prozent reduzieren. In besonders rechenintensiven Szenarien lag die Einsparung sogar bei nahezu 99 Prozent. Das bedeutet, dass Entwickler und Forscher viel schneller und kostengünstiger fundierte Entscheidungen darüber treffen können, welche Modelle wie und wo eingesetzt werden sollen. Die Bedeutung dieser Einsparungen ist nicht zu unterschätzen.

Der Ressourcenverbrauch beim Training und der Anpassung großer Modelle ist ein wichtiger Kostenfaktor, der sowohl finanzielle als auch ökologische Auswirkungen hat. Indem COSMOS eine Methode anbietet, diese Prozesse wesentlich effizienter zu gestalten, trägt das Framework zur nachhaltigen Entwicklung der KI-Community bei und macht fortschrittliche Technologien zugänglicher für ein breiteres Spektrum an Anwendern. Darüber hinaus unterstützt COSMOS nicht nur einzelne Akteure bei der Modellentwicklung, sondern fördert auch eine effektivere Nutzung von großen Sprachmodellen in realen Szenarien. Organisationen können schneller experimentieren, mit unterschiedlichen Modellgrößen und Anpassungsstrategien spielen und so eine optimale Balance zwischen Leistung und Kosten finden. Dies ist gerade in dynamischen Umgebungen wichtig, in denen Anforderungen sich schnell ändern und Flexibilität gefragt ist.

Die Entwicklung von COSMOS ist ein weiterer Beleg dafür, wie Forschungstechnologien dazu beitragen können, die praktische Nutzbarkeit von KI-Anwendungen maßgeblich zu verbessern. Neben der reinen Leistungssteigerung lenkt das Projekt die Aufmerksamkeit zunehmend auf nachhaltige und gut planbare Ressourcennutzung. So verbindet COSMOS Innovation mit pragmatischem Nutzen. Langfristig gesehen bedeutet der Erfolg solcher Vorhersagemodelle, dass die Anpassung von LLMs für viele Unternehmen und Entwickler nicht nur einfacher, sondern auch wirtschaftlich tragfähig wird. Gerade Start-ups und kleinere Forschungsteams profitieren von einem reduzierten Bedarf an teuren Hardware-Ressourcen und langen Trainingszyklen.

Gleichzeitig ermöglicht COSMOS eine wissenschaftlich fundierte Entscheidungsgrundlage, die den Weg zu neuen, kreativen Anwendungen im Bereich der natürlichen Sprachverarbeitung ebnet. Im Gesamtbild ist COSMOS ein wegweisendes Framework, das den Spagat zwischen anspruchsvoller Modellanpassung und praxisorientierter Effizienz elegant meistert. Es öffnet die Tür zu einer neuen Generation von KI-Systemen, die besser kalkulierbar, kosteneffektiver und ressourcenschonender sind. Wer sich mit der Implementierung von Large Language Models beschäftigt, sollte die Möglichkeiten von COSMOS kennen und in Betracht ziehen, um zukünftige Projekte erfolgreicher und nachhaltiger zu gestalten. Die Zukunft der KI-Anpassung liegt damit nicht nur in der Entwicklung noch größerer und leistungsfähigerer Modelle, sondern vor allem auch in einer intelligenten und durchdachten Auswahl sowie effizienten Nutzung vorhandener Ressourcen.

COSMOS bietet dafür die notwendige technologische Grundlage und könnte sich als unverzichtbares Werkzeug in der Toolbox moderner KI-Entwickler etablieren. Die Fortschritte im Bereich der Vorhersage von Anpassungsergebnissen werden die Art und Weise verändern, wie wir mit großen Sprachmodellen arbeiten, und einen wichtigen Beitrag dazu leisten, dass KI-Technologie für alle zugänglicher, bezahlbarer und nachhaltiger wird.