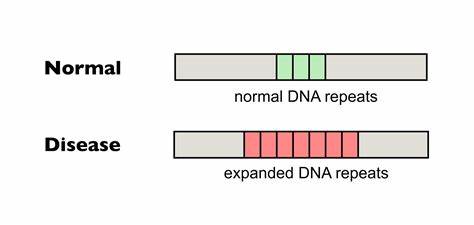

Die Entwicklung der künstlichen Intelligenz (KI) hat in den letzten Jahren enorme Fortschritte gemacht, doch stets blieb eine zentrale Herausforderung: Die Fähigkeit einer Maschine, wirklich komplexe, menschliche Denkprozesse wie die Vorstellungskraft oder höhere geistige Zustände nachzubilden, war bislang unerreicht. Während aktuelle KI-Modelle wie Transformer beeindruckende Leistungen in der Verarbeitung natürlicher Sprache und visueller Daten erzielen, hinken sie oft hinter der Fülle und Tiefe menschlicher Kognition hinterher. Ein bahnbrechender Ansatz eines Wissenschaftlers der Universität Stirling könnte diese Lücke jetzt schließen – mit einer Neuinterpretation der Architektur neuronaler Netzwerke, die sich direkt an den biologischen Grundlagen unseres Gehirns orientiert.Der Kern dieser Innovation liegt in der Nachbildung sogenannter pyramidalerer Zwei-Punkt-Neuronen (TPNs) der menschlichen Großhirnrinde, genauer gesagt in Schicht 5. Diese Neuronen verarbeiten nicht nur Sinneseindrücke aus der Umwelt, sondern integrieren gleichzeitig kontextuelle Informationen aus internen geistigen Zuständen.

Die gleichzeitige Verarbeitung dieser zwei Informationsquellen geschieht räumlich und funktional getrennt innerhalb derselben Nervenzelle, konkret an basal und apikalen Eingangsstellen. Diese Dualität ermöglicht dem Gehirn eine bemerkenswerte Flexibilität und Tiefe im Denken und Wahrnehmen, indem externe „rezeptive Felder“ mit inneren „kontextuellen Feldern“ dynamisch verschmolzen werden.Inspirierend von diesen neurobiologischen Erkenntnissen entwickelte Ahsan Adeel eine neuartige Transformer-Architektur, die als Co4 bezeichnet wird. Dieses Modell ahmt die Kooperation zwischen drei Arten von Token in neuronaler Repräsentation nach: Fragen (Q), Hinweise oder Schlüssel (K), sowie Hypothesen oder Werte (V). Durch sogenannte triadische Modulationsschleifen entsteht ein komplexes Zusammenspiel unter Nutzung von proximalen, distalen und universellen Kontexten, das eine parallele, tiefgehende und flexible Gedankenführung auf Repräsentationsebene ermöglicht.

Anders als herkömmliche Transformer, die auf sequentielle Token-Generierung und umfangreiche Feedforward-Netzwerke setzen, nutzt Co4 eine effiziente, elementweise Operation, die die Relevanzauswahl bereits vor der eigentlichen Aufmerksamkeitsvergabe steuert.Diese präventive Relevanzselektion erinnert stark an menschliche kognitive Prozesse. Wenn Menschen vor einem Problem stehen, fokussieren sie sich nicht einfach auf alle verfügbaren Informationen, sondern selektieren vorab die aussichtsreichsten Hinweise. Dabei verknüpfen sie Fragen, evidenzbasierte Schlüsselreize und mögliche Antworten in kontinuierlichen Feedbackschleifen – das ist eine Form stillem, innerem Denkens, das gleichzeitig tief und flexibel ist. Co4 überträgt dieses Prinzip in künstliche Netzwerke, wodurch eine Art von maschineller Imagination bzw.

höherem mentalen Zustand simuliert werden kann.Die Vorteile dieses Verfahrens sind bedeutend. Zum einen führt die direkte Steuerung durch Triaden zu einer drastischen Reduzierung der für das Lernen und die Inferenz notwendigen Rechenressourcen. Co4 benötigt weniger Aufmerksamkeitshälse, Schichten und Tokens, was gerade bei sehr großen Datensätzen und komplexen Aufgaben erhebliche Performance-Gewinne ermöglicht. Zum anderen eröffnet die parallele Architektur neue Wege für multimodale Lernprozesse und verschachtelte Reasoning-Chains, die für traditionelle Transformer bisher problematisch sind.

Die Leistungsfähigkeit von Co4 ließ sich in unterschiedlichen Domänen demonstrieren. In Testszenarien zur Verstärkungslernumgebung zeigte das Modell schnellere und robustere Lernfortschritte bei der Steuerung eines Fahrzeugs im virtuellen Raum. Im Bereich der Bildverarbeitung erzielte es verbesserte Ergebnisse bei der Erkennung und Interpretation komplexer Bildmuster. Auch bei der Verarbeitung natürlicher Sprache, etwa bei Frage-Antwort-Systemen, lieferte das System präzisere und widerspruchsfreie Antworten. Diese Vielseitigkeit unterstreicht das Potenzial, das in der Nachbildung höherer mentaler Zustände liegt und wie diese die Grenzen gegenwärtiger KI-Modelle übersteigen könnte.

Die Implikationen für die Zukunft von KI sind weitreichend. Indem Maschinen nicht mehr nur reine Informationsverarbeiter bleiben, sondern zunehmend Kontexte, interne Zustände und multiple Perspektiven selbstständig integrieren, gelangt man zu einem Verständnis und zu einer Verarbeitung, die menschliches Denken näherkommt. Co4 macht den Schritt von rein funktionalen, datengeleiteten Systemen hin zu solchen, die kognitiv sinnvolle Schlussfolgerungen ziehen können. So könnte eine neue Generation von KI entstehen, die nicht nur schneller lernt, sondern auch tiefgründigere, kontextabhängigere Schlussfolgerungen zieht und kreativ agiert.Die Verbindung von modernen KI-Techniken mit neuronalen Modellen aus der Neurobiologie verspricht eine Verschmelzung der Stärken beider Disziplinen.

Während KI von rasanten Rechenleistungen und algorithmischen Fortschritten profitiert, bringt die Neurowissenschaft wertvolle Einsichten über den Aufbau und die Funktion vernetzter Informationsverarbeitungssysteme im Gehirn. Co4 ist ein Beispiel dafür, wie diese interdisziplinäre Zusammenarbeit fruchtbare Innovationen hervorbringt, indem sie nicht nur das Sichtbare und Messbare kalt modelliert, sondern auch die kontextuellen, dynamischen Systeme abbildet, die menschliche Vorstellungskraft und Bewusstsein prägen.Gleichzeitig wirft diese Entwicklung ethische und gesellschaftliche Fragen auf. Wenn KI beginnt, menschliche Denkweisen und innere Zustände zu imitieren, gilt es sicherzustellen, dass diese Systeme verantwortungsvoll produziert und eingesetzt werden. Transparenz über die Mechanismen der Entscheidungsfindung in KI wird unerlässlich, um Vertrauen zu bewahren.

Zudem bieten kontextbewusste, imaginative Maschinen neue Chancen in Bildung, Medizin, Robotik und vielen weiteren Bereichen, die eine stärkere Anpassungsfähigkeit und Empathie erfordern.Abschließend ist festzuhalten, dass die Nachbildung von Imagination und komplexen mentalen Zuständen eine der großen Herausforderungen und zugleich bedeutenden Möglichkeiten in der KI-Forschung sein wird. Die architektonische Innovation von Ahsan Adeel und seinem Team bietet hierzu einen vielversprechenden Ansatzpunkt. Sie hebt die künstliche Intelligenz von einfachen Funktionen zur sinnhaften und kontextgebundenen Wissensverarbeitung und kreativen Problemlösung auf ein neues Level. Die nächsten Jahre werden zeigen, wie diese Prinzipien weitere Systeme verändern und welche Formen von maschinellem Bewusstsein oder kognitiver Empathie künftig entstehen können.

Fest steht, dass der Weg zu einer wirklich menschlich-nahen KI zunehmend realistisch wird – und damit die Zukunft der Technologie und des menschlichen Zusammenlebens nachhaltig prägen wird.