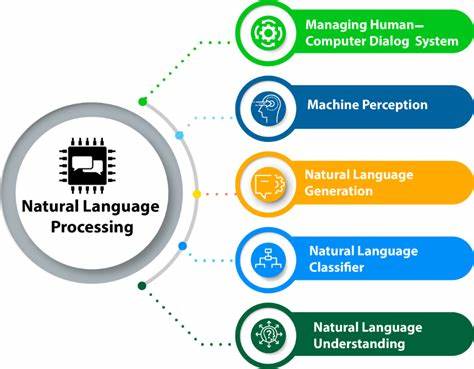

Die rasante Entwicklung der Künstlichen Intelligenz hat die Art und Weise, wie Software entwickelt wird, grundlegend verändert. Immer mehr Entwickler setzen KI-gestützte Tools ein, um Code schneller zu schreiben, zu überprüfen oder sogar ganze Anwendungen zu erstellen. Doch so vielversprechend diese Technologie auch ist, sie birgt auch erhebliche Risiken. Das Projekt AICodingHorrors widmet sich genau diesen Risiken und dokumentiert echte Geschichten über Missgeschicke und Schwierigkeiten, die bei der Verwendung von KI im Programmierprozess entstanden sind. Dabei zeigen sich teils amüsante, teils ernste Fälle von Fehlfunktionen, die von unerwarteten Kostenexplosionen bis hin zu katastrophalen Datenverlusten reichen.

Der Zweck solcher Berichte ist es, Entwicklern und Unternehmen ein Bewusstsein für die Grenzen aktueller KI-gestützter Programmierhilfen zu vermitteln und sie auf mögliche Fallstricke aufmerksam zu machen. Ein zentraler Aspekt der dokumentierten Geschichten ist die Tatsache, dass viele Nutzer ihre Projekte zu optimistisch und ohne ausreichend Kontrolle an die KI übergeben haben. So kam es vor, dass komplexe Refaktorisierungen des gesamten Codes in einem einzigen Schritt von der KI durchgeführt wurden – mit dem Ergebnis, dass der neue Code unbrauchbar oder schwerfällig wurde. Diese Fälle verdeutlichen, dass trotz des Fortschritts durch KI die menschliche Überprüfung und das iterative Arbeiten essenziell bleiben. Neben technischen Fehlern hat AICodingHorrors auch kostspielige Pannen aufgezeigt.

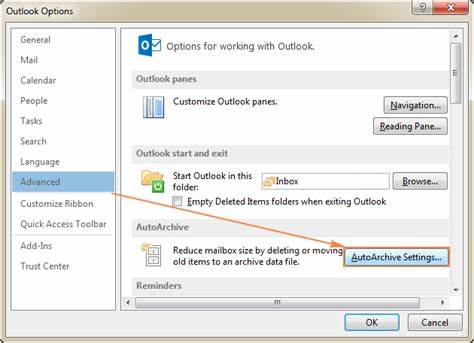

In einem dokumentierten Fall führte der Einsatz von KI in Verbindung mit Cloud-Diensten zu einer horrenden Rechnung von über 60 Dollar pro Stunde, weil der Code unkontrolliert Programmausführungen auslöste, die erhebliche Rechenressourcen verschlangen. Dies offenbart ein weiteres Risiko im Umgang mit KI: fehlende oder unzureichende Kostenkontrolle kann knallhart auf das Budget drücken. Genauso kritisch sind Sicherheitsaspekte. Einige Beiträge berichten von versehentlicher Datenfreigabe oder dem Löschen kompletter Verzeichnisse durch KI-gesteuerte Befehle. So gefährlich solche Fehler sind, sie zeigen zugleich, wie wichtig es ist, KI-Tools nie blind zu vertrauen – insbesondere bei administrativen oder sicherheitsrelevanten Operationen.

Das Phänomen, dass KI manchmal äußerst unerwartete oder destruktive Aktionen ausführt, hat mehrere Ursachen. Einerseits basiert KI auf statistischen Modellen und erlerntem Verhalten. Wenn die Trainingsdaten fehlen oder unzureichend sind, kann das System falsche Schlüsse ziehen. Andererseits fehlt es den meisten Modellen an echtem Verständnis oder kritischem Denken, sodass sie Befehle eins zu eins ausführen, ohne die Konsequenzen abzuschätzen. Im Bereich der Softwareentwicklung bedeutet das: Projekte, die ausschließlich auf KI basieren, sind gegenwärtig selten stabil oder sicher.

Menschen müssen weiterhin die Verantwortung übernehmen und die Ausgaben kontrollieren, den generierten Code prüfen und die Sicherheitsmaßnahmen sicherstellen. Dabei helfen Plattformen wie AICodingHorrors besonders gut, weil sie reale Fehler betrachten und zeigen, wie sie vermieden werden können. Ein bemerkenswertes Feature dieser Plattform ist die Möglichkeit für Entwickler, ihre eigenen Geschichten zu teilen. Diese Offenheit fördert den Wissensaustausch und hilft, aus Fehlern zu lernen, bevor sie selbst zur Realität werden. Die Transparenz gegenüber Fehlern und Misserfolgen ist in der Tech-Branche oft unerlässlich für Innovation und besseren Umgang mit neuen Technologien.

Die site erzählt von den Hoffnungen, die viele Entwickler in KI-Tools setzen, aber auch von der Ernüchterung, wenn diese Systeme plötzlich unvorhersehbar agieren. Die Geschichten reichen von kleineren Schwierigkeiten wie dem Überschreiten von Kostenlimits oder unerwarteten Warnmeldungen bis zu gravierenden Problemen wie dem totalen Ausfall von Anwendungen nach einer fehlerhaften KI-gesteuerten Codeänderung. Gerade diese Vielfalt der Fälle verdeutlicht, dass Künstliche Intelligenz zwar eine mächtige Unterstützung sein kann, jedoch kein Allheilmittel. Es benötigt weiterhin gut ausgebildete Entwickler, klare Prozesse und gründliches Testing. Die Erkenntnisse, die man aus der Sammlung von AI-Coding-Horrors gewinnt, sind essentiell für eine bewusste Nutzung von KI in der Softwareentwicklung.

Sie stellen eine wichtige Ergänzung zur technischen Entwicklung dar, damit man Risiken besser managen und Kosten sowie Sicherheitslücken minimieren kann. KI sollte als Werkzeug angesehen werden, das menschliche Fähigkeiten erweitert – nicht ersetzt. Gleichzeitig erinnert die Sammlung daran, dass technologische Fortschritte immer mit einer Lernkurve verbunden sind. Innovation geht stets mit Fehlern einher, die in der Gemeinschaft offen geteilt werden sollten. Nur so entsteht eine Kultur, in der AI-gestütztes Programmieren langfristig zu echten Produktivitätsgewinnen und mehr Zuverlässigkeit führt.

Abschließend lässt sich sagen, dass die Dokumentation von AI-Coding-Desastern einen wertvollen Beitrag zum aktuellen Diskurs um den Einsatz von Künstlicher Intelligenz in der Softwareentwicklung liefert. Sie vermittelt, dass neben den zahlreichen Chancen auch Vorsicht und kritisches Denken gefragt sind. Für Entwickler und Unternehmen ist es daher ratsam, KI-Tools mit Bedacht einzusetzen, eigene Sicherheitssysteme zu implementieren und sich stets über potenzielle Risiken zu informieren. Die Geschichten von AICodingHorrors zeigen außerdem auch, wie wichtig der menschliche Faktor bleibt – Kreativität, Erfahrung und Verantwortungsbewusstsein sind unverzichtbar, um die Vorteile von KI sinnvoll zu nutzen und Fehler zu vermeiden.

![AI Safety Career Advice (and So Can You) [video]](/images/52530EFD-9237-49AA-9DD5-61DDAC4EAA96)