Die Plattform Instagram, die zu Meta gehört, hat sich in den letzten Jahren zu einem der einflussreichsten sozialen Netzwerke weltweit entwickelt. Mit Millionen von Nutzern täglich ist es ein Ort, an dem persönliche Geschichten, kreative Projekte und geschäftliche Aktivitäten miteinander verschmelzen. Doch trotz der enormen Popularität steht Instagram aktuell vor einer ernsthaften Herausforderung: Meta suspendiert massenhaft Benutzerkonten, basierend auf Entscheidungen einer fehlerhaften Künstlichen Intelligenz (KI). Diese Praxis führt zu einer Welle von Beschwerden und lässt viele Nutzer ratlos zurück, da ihre Profile ohne klare Begründung eingeschränkt oder gar gesperrt werden. Die Hintergründe, Auswirkungen und Zukunftsperspektiven dieser Problematik sind vielfältig und verlangen eine differenzierte Betrachtung.

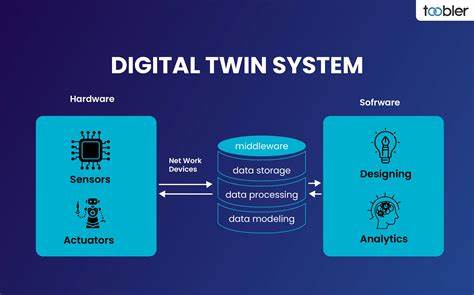

Im Kern basiert die Problematik auf der zunehmenden Automatisierung von Moderationsprozessen, die Meta eingeführt hat, um Inhalte zu kontrollieren und Verstöße gegen Gemeinschaftsrichtlinien zu identifizieren. KI-Systeme sollen dabei helfen, unangemessene Inhalte schnell zu erkennen und entsprechende Maßnahmen einzuleiten. Allerdings hat sich herausgestellt, dass diese Systeme in vielerlei Hinsicht noch nicht ausgereift sind. Fehlinterpretationen von Bildern, Texten und Kontexten führen häufig zu falschen Sperrungen. Nutzer, die sich an keine Regeln gehalten haben, werden unberechtigterweise abgestraft, während tatsächliche Verstöße teilweise unbemerkt bleiben.

Was genau sind die Ursachen für diese Fehler? Die eingesetzten KI-Modelle basieren auf Trainingsdaten, Algorithmen und Richtlinien, die nicht alle denkbaren Nuancen menschlicher Kommunikation erfassen können. Insbesondere kulturelle Unterschiede, sprachliche Feinheiten und kontextuelle Hintergründe übersteigen die derzeitigen Fähigkeiten vieler automatisierter Systeme. Ein weiteres großes Problem ist die mangelnde Transparenz. Nutzer erhalten oft wenig bis gar keine sachlichen Erklärungen für die Sperrungen oder die Möglichkeit, effektiv Widerspruch einzulegen. Dies führt zu Frustration und Vertrauensverlust gegenüber der Plattform.

Die Folgen für die betroffenen Anwender sind gravierend. Viele Menschen nutzen Instagram nicht nur privat, sondern auch beruflich, um ihre Marke zu promoten oder Produkte zu verkaufen. Eine plötzliche Sperrung des Accounts kann wirtschaftliche Einbußen, Imageverluste oder sogar Existenzängste verursachen. Insbesondere kleine Unternehmen und Kreative sind hier besonders anfällig. Neben den individuellen Schäden wird auch das allgemeine Nutzererlebnis negativ beeinflusst, was sich langfristig auf die Attraktivität der Plattform selbst auswirken könnte.

Darüber hinaus eröffnet die Situation eine breitere gesellschaftliche Debatte über die Verantwortung von Tech-Konzernen und den ethischen Einsatz von Künstlicher Intelligenz. Unternehmen tragen eine enorme Verantwortung, wenn sie die Rechte ihrer Nutzer schützen und gleichzeitig Plattformen sicher und regelkonform halten wollen. Eine rein automatisierte Entscheidungsfindung ohne angemessene menschliche Kontrolle kann diese Balance gefährden. Mehrere Experten und Menschenrechtsorganisationen fordern deshalb eine Revision der automatischen Moderationsmechanismen bei Meta. Vorschläge reichen von der Verbesserung der KI-Trainingsdaten über die Integration von menschlichen Prüfern bis hin zur Einrichtung transparenter und schneller Beschwerdeprozesse.

Die Forderung nach einer verstärkten Kontrolle durch unabhängige Instanzen und klaren Richtlinien zum Schutz der Meinungsfreiheit wird ebenfalls lauter. Meta reagiert auf die Kritik mit dem Hinweis, dass automatisierte Systeme notwendig seien, um die Plattform für Milliarden von Nutzern sicher zu halten und etwaige Hassrede, Missbrauch oder Fehlinformationen zu bekämpfen. Sie geben zu, dass Herausforderungen bestehen und arbeiten kontinuierlich an der Verbesserung ihrer Algorithmen und Prozesse. Dennoch zeigt die aktuelle Situation, dass dieser Weg mit Risiken verbunden ist und eine bloße technologische Lösung nicht ausreicht. Zusätzlich entwickelt sich der Markt stetig weiter, neue Plattformen entstehen und Nutzer verlagern sich je nach Erfahrung und Vertrauen.

Instagram steht somit vor der Herausforderung, Nutzervertrauen wiederherzustellen und klare Standards zu etablieren, die sowohl Sicherheit gewährleisten als auch faire Behandlung sicherstellen. Innovation darf nicht zulasten der Rechte und der Würde der Anwender gehen. Die wichtigsten Erkenntnisse aus der Debatte um Metas fehlerhafte AI-Sperrungen machen deutlich, dass eine symbiotische Beziehung zwischen Technologie und menschlicher Kontrolle unerlässlich ist. Die Technologie kann zwar unterstützen und Prozesse beschleunigen, menschliche Sensibilität und Kontextverständnis bleiben aber unersetzlich. Nur so ist es möglich, eine faire, transparente und nutzerorientierte Plattform zu schaffen, die den Ansprüchen einer vielfältigen und globalen Nutzerschaft gerecht wird.

Abschließend lässt sich festhalten, dass der Umgang mit fehlerhaften AI-Systemen in sozialen Medien ein komplexes Thema darstellt, das keinesfalls leicht zu beheben ist. Es erfordert Zusammenarbeit zwischen Technologieanbietern, Nutzern, Regulierungsbehörden und anderen Stakeholdern. Eine offene Diskussion und kontinuierliche Verbesserungen sind notwendig, damit Plattformen wie Instagram auch in Zukunft ein sicherer und vertrauenswürdiger Ort im digitalen Raum bleiben können.